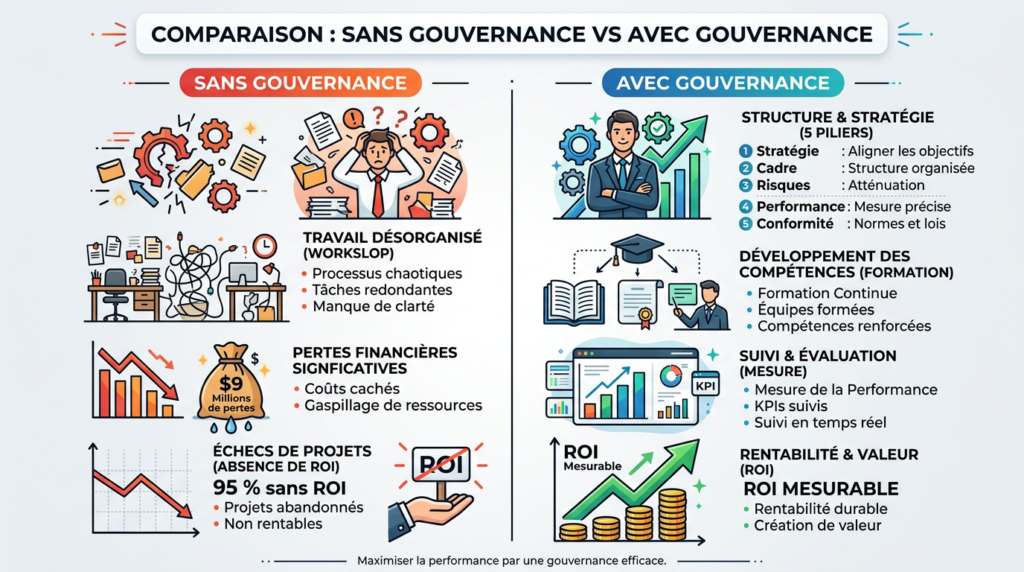

Les entreprises investissent massivement dans l’intelligence artificielle. Pourtant, 95 % d’entre elles n’en tirent aucun retour mesurable. Pire : sans gouvernance IA entreprise, le phénomène du « workslop » — travail bâclé généré par IA — coûte jusqu’à 9 millions de dollars par an aux grandes organisations. Du scandale Deloitte en Australie aux chiffres accablants du MIT Media Lab, cet article décrypte le chaos silencieux et propose un cadre d’action concret.

Le chiffre est brutal. Il devrait hanter chaque comité de direction. Selon une étude du MIT Media Lab publiée en juillet 2025, 95 % des organisations ne tirent aucun retour mesurable de leurs investissements en intelligence artificielle générative. Et ce, malgré 30 à 40 milliards de dollars injectés à l’échelle mondiale. Le problème n’est pas technologique. Il est humain. Il est organisationnel. Il est structurel.

La gouvernance IA entreprise — cet ensemble de règles, de processus et de responsabilités qui encadrent l’usage de l’intelligence artificielle — n’est plus un luxe réglementaire. C’est une question de survie économique. Sans elle, l’IA ne transforme rien. Elle amplifie le désordre.

L’essentiel. La quasi-totalité des projets IA en entreprise échouent faute de gouvernance adaptée. Le phénomène du « workslop » — travail superficiel généré par IA — coûte près de 9 millions de dollars annuels aux grandes organisations. L’IA n’est pas un correcteur d’incompétence : c’est un amplificateur. Seules les entreprises qui structurent un cadre clair — formation ciblée, charte d’usage, supervision humaine — transforment réellement leur activité.

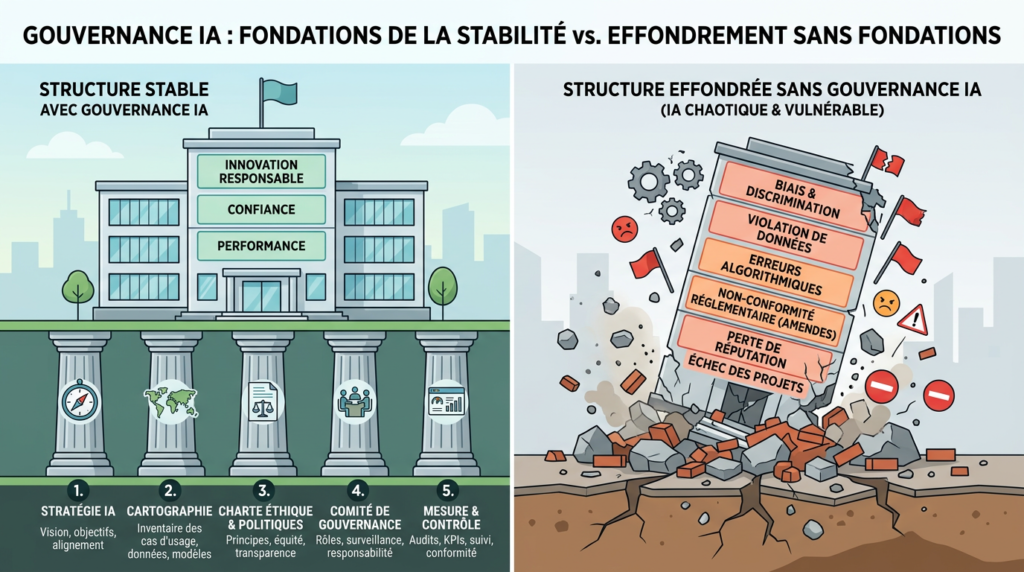

La gouvernance IA entreprise désigne l’ensemble des politiques, processus, rôles et contrôles qui garantissent qu’un système d’intelligence artificielle reste fiable, conforme et aligné sur les objectifs métier. Elle couvre le cycle de vie complet de l’IA, de l’idéation au déploiement, en passant par la supervision continue et la gestion des incidents.

Il y a quelque chose de fascinant dans l’aveuglement collectif. Les entreprises se ruent vers l’IA avec l’enthousiasme d’un chercheur d’or. Pourtant, la rivière est presque tarie.

Le rapport « The GenAI Divide » du MIT Media Lab dresse un constat sans appel. Sur plus de 300 initiatives IA analysées, à peine 5 % ont produit un impact mesurable sur le compte de résultat. Les autres ? Des projets pilotes sans lendemain. Des expérimentations coûteuses restées en marge des processus réels.

Ce n’est pas la qualité des modèles qui pose problème. C’est l’absence de cadre. Les outils grand public comme ChatGPT ou Copilot sont adoptés par plus de 80 % des organisations. Néanmoins, cette adoption reste superficielle. Elle améliore la productivité individuelle. Elle ne transforme pas l’entreprise.

En réalité, le fossé se creuse entre ceux qui expérimentent et ceux qui transforment. Les chercheurs du MIT l’appellent le « GenAI Divide ». D’un côté, une minorité qui structure, gouverne et mesure. De l’autre, une immense majorité qui pilote à l’aveugle.

Les chiffres donnent le vertige. L’usage de l’IA au travail a doublé depuis 2023, passant de 21 % à 40 % des salariés selon Gallup. Pourtant, comme le rappelle une analyse approfondie de l’adoption IA en entreprise, cette croissance n’engendre pas automatiquement des résultats.

Le problème est structurel. Seulement 19 % des travailleurs du savoir disposent de directives claires sur l’usage de l’IA, selon le rapport d’Asana sur l’état de l’IA au travail. Autrement dit, quatre salariés sur cinq naviguent sans boussole. Ils utilisent l’IA comme ils l’entendent. Parfois avec brio. Souvent sans discernement.

Dès lors, un phénomène inattendu émerge. L’IA, censée accélérer le travail, finit par en créer davantage. C’est le paradoxe fondamental que les organisations refusent encore de regarder en face.

Le mot est nouveau. La réalité qu’il décrit, elle, s’installe partout. « Workslop » — contraction de work et slop — désigne ce travail bâclé, généré par IA, qui se fait passer pour du travail accompli. Des rapports bien formatés mais vides de substance. Des présentations fluides mais dénuées de pensée. Du contenu qui semble professionnel, mais qui n’avance rien.

Le terme a été forgé par les chercheurs de Stanford et de BetterUp Labs, par analogie avec le « slop » qui envahit les réseaux sociaux. Mais dans le contexte professionnel, les dégâts sont bien plus graves.

L’enquête menée auprès de 1 150 travailleurs américains révèle une réalité alarmante. Environ 40 % des salariés déclarent avoir reçu du workslop au cours du mois écoulé. Ces employés estiment qu’en moyenne 15 % du contenu qu’ils reçoivent relève de ce travail artificiel et creux.

Le mécanisme est pervers. Un collaborateur utilise l’IA pour produire rapidement un livrable. Le résultat paraît soigné. En effet, les modèles de langage excellent dans l’art de la prose fluide. Toutefois, sous cette surface lisse se cache souvent un vide intellectuel. Pas de réflexion. Pas de contextualisation. Pas de valeur ajoutée.

C’est précisément ce qui rend le workslop si dangereux. Il transfère la charge de travail en aval. Le destinataire doit décoder, vérifier, corriger. Parfois recommencer entièrement. Le fardeau passe du créateur au récepteur sans que personne ne s’en aperçoive immédiatement.

Les chiffres publiés par Harvard Business Review en septembre 2025 sont édifiants. Chaque incident de workslop représente en moyenne une heure et cinquante-six minutes de temps perdu pour le destinataire. Rapporté aux salaires déclarés, cela constitue une taxe invisible d’environ 186 dollars par mois et par employé.

À l’échelle d’une organisation de 10 000 personnes, avec un taux de prévalence de 41 %, le coût annuel dépasse 9 millions de dollars. En pure perte de productivité.

Par ailleurs, les dégâts ne sont pas qu’économiques. La moitié des personnes interrogées jugent leurs collègues producteurs de workslop moins créatifs, moins compétents et moins fiables qu’auparavant. Un tiers se dit réticent à collaborer à nouveau avec eux. Ainsi, le workslop ne détruit pas seulement la productivité. Il corrode la confiance.

Dans notre pratique d’accompagnement des PME, nous observons ce phénomène avec une régularité inquiétante. Des dirigeants enthousiastes déploient l’IA sans cadre. Six mois plus tard, les équipes produisent davantage de contenu. Mais la qualité chute. Les réunions s’allongent pour démêler le vrai du faux. La gouvernance IA entreprise n’est pas un frein à l’innovation. C’est son garde-fou indispensable.

Si le workslop est un phénomène diffus, certains cas cristallisent le problème avec une brutalité exemplaire. L’affaire Deloitte Australie en est l’illustration parfaite.

En juillet 2025, le gouvernement australien publie un rapport de 237 pages commandé à Deloitte pour 440 000 dollars australiens. L’objet : évaluer le système automatisé de sanctions dans le dispositif social du pays. Un sujet sensible. Des enjeux considérables.

Or, un chercheur de l’Université de Sydney, Chris Rudge, découvre rapidement que le document est truffé de références fabriquées. Des ouvrages académiques qui n’existent pas. Des auteurs cités pour des travaux qu’ils n’ont jamais réalisés. Une citation de magistrat inventée de toutes pièces. Rudge identifie au moins vingt erreurs majeures.

Deloitte finit par admettre avoir utilisé Azure OpenAI GPT-4o dans la rédaction du rapport. Sans le déclarer au client. Sans vérifier les résultats. Le cabinet est contraint de rembourser partiellement le gouvernement australien.

Mais l’histoire ne s’arrête pas là. En novembre 2025, un rapport similaire refait surface au Canada. Même cabinet. Même problème. Des citations fabriquées dans un document de santé publique facturé 1,6 million de dollars canadiens.

La sénatrice australienne Barbara Pocock résume la situation avec une clarté cinglante : les erreurs relevées sont du niveau d’un étudiant de première année. Ce qui rend l’affaire stupéfiante, c’est qu’elle implique l’un des quatre plus grands cabinets de conseil au monde. Si Deloitte peut tomber dans ce piège, n’importe quelle organisation le peut.

Ce qui a échoué, ce n’est pas l’IA. C’est l’absence totale de processus de vérification. C’est la confiance aveugle dans un outil qui génère du texte plausible — pas du texte véridique. C’est, en un mot, l’absence de gouvernance.

L’affaire Deloitte n’est que la partie visible de l’iceberg. Sous la surface, des milliers d’organisations avancent sans cadre. Les conséquences s’accumulent silencieusement.

Le rapport du MIT établit une distinction fondamentale. Deux industries seulement montrent des signes de disruption structurelle par l’IA : la technologie et les médias. Sept autres secteurs — dont la finance, la santé et le retail — restent bloqués au stade de l’expérimentation.

En effet, la plupart des entreprises traitent l’IA comme un outil ponctuel. Elles l’ajoutent à des processus existants sans repenser ces processus. C’est comme installer un moteur de course sur une charrette. La puissance est là. La direction manque.

Le World Economic Forum confirme cette tension dans son Future of Jobs Report 2025. D’un côté, 40 % des employeurs prévoient de réduire leurs effectifs là où l’IA peut automatiser les tâches. De l’autre, 85 % déclarent vouloir former leur personnel. Le paradoxe est flagrant : on veut remplacer et former simultanément, souvent sans savoir qui fait quoi avec l’IA.

Un phénomène particulièrement préoccupant émerge de ces données. Plus de 90 % des salariés des entreprises sondées par le MIT utilisent des outils d’IA personnels au travail. Pourtant, seulement 40 % des entreprises ont souscrit un abonnement officiel.

Cette « IA fantôme » — l’équivalent du shadow IT pour l’intelligence artificielle — échappe à tout contrôle. Les données sensibles transitent vers des serveurs externes. Les résultats ne sont ni vérifiés ni traçables. Aucune charte n’encadre ces usages.

Comme le souligne le cadre réglementaire de l’EU AI Act que chaque entreprise doit connaître, la conformité n’est plus optionnelle. Le règlement européen impose des obligations de transparence, de documentation et de contrôle des risques. Les sanctions peuvent atteindre 35 millions d’euros ou 7 % du chiffre d’affaires mondial.

Néanmoins, au-delà de la contrainte réglementaire, c’est la logique économique qui impose la gouvernance. Sans cadre, l’IA produit du bruit. Avec un cadre, elle produit de la valeur.

Passons de l’analyse au mode opératoire. La gouvernance IA entreprise ne se décrète pas. Elle se construit méthodiquement.

La stratégie d’abord. Toute démarche commence par une question simple : quel problème métier voulons-nous résoudre ? L’IA n’est pas une fin en soi. Elle est un levier. Sans objectif clair, elle devient un centre de coûts.

La cartographie des usages. Il s’agit d’identifier précisément quels outils IA sont utilisés dans l’organisation. Y compris — et surtout — ceux qui ont été adoptés sans validation officielle. Le shadow AI représente le risque le plus immédiat. Un audit honnête constitue la première étape indispensable.

La charte d’usage. Ce document opérationnel définit les règles du jeu. Quels cas d’usage sont autorisés. Quelles données peuvent être soumises aux modèles. Quel niveau de supervision humaine est requis. La charte ne doit pas être un document juridique hermétique. Elle doit être comprise par chaque collaborateur.

Le comité de gouvernance. Une instance dédiée, réunissant direction, DSI, DPO et métiers, assure le pilotage continu. Ce comité valide les nouveaux cas d’usage, surveille les indicateurs de performance et coordonne les réponses aux incidents.

La mesure continue. Ce qui ne se mesure pas ne s’améliore pas. Taux de vérification des sorties IA. Incidents de workslop détectés. Conformité réglementaire. Ces indicateurs transforment la gouvernance en levier d’amélioration permanente.

C’est peut-être la leçon la plus contre-intuitive de cette révolution. Avant de déployer des outils, il faut former les personnes. Selon BPI France, 66 % des PME et ETI françaises forment déjà leurs employés à l’IA. Toutefois, seuls 34 % investissent dans la formation à la collecte et à la gestion des données — le socle sur lequel repose tout usage intelligent de l’IA.

La formation IA en entreprise n’est pas un bonus. C’est le prérequis absolu. Car le problème du workslop naît précisément de l’écart entre l’accessibilité de l’outil et la compétence de l’utilisateur.

Les recherches de Stanford et BetterUp identifient deux profils distincts. Les « pilotes », dotés d’un fort sentiment d’agence et d’optimisme, utilisent l’IA de manière intentionnelle et créative. Ils sont 3,6 fois plus productifs que la moyenne. Les « passagers », eux, subissent l’outil. Ils l’utilisent comme un raccourci. Et produisent du workslop.

Dès lors, la formation ne doit pas viser la technique. Elle doit développer le discernement. Savoir quand utiliser l’IA. Savoir quand s’en passer. Savoir vérifier, contextualiser, enrichir. C’est une compétence intellectuelle, pas informatique.

Il existe une croyance tenace selon laquelle l’IA nivelle les compétences. Qu’elle rendrait les moins qualifiés aussi performants que les meilleurs. Cette croyance est dangereuse.

En réalité, l’IA amplifie ce qui existe déjà. Un expert qui maîtrise son domaine produit des résultats exceptionnels avec l’IA. Un novice qui ne maîtrise rien produit du contenu plausible mais creux. Pire : il ne dispose pas des compétences nécessaires pour détecter les erreurs de l’IA. Il ne sait même pas ce qu’il ne sait pas.

C’est ce que les chercheurs appellent la « zone de danger ». L’IA génère des analyses au ton autoritaire que les utilisateurs inexpérimentés n’ont ni la capacité ni le réflexe de vérifier. Le résultat semble sophistiqué. Le raisonnement paraît solide. Mais sous la prose fluide peut se cacher un non-sens complet.

Le principe de Pareto appliqué aux organisations révèle une vérité inconfortable. Dans toute structure, une minorité de collaborateurs génère l’essentiel de la valeur. Ce sont ces profils qu’il faut identifier et équiper en priorité. Donner l’IA à tout le monde, sans distinction, sans formation, sans cadre, c’est industrialiser les erreurs de la majorité.

C’est pourquoi la sécurité IA en entreprise ne concerne pas uniquement la cybersécurité ou la protection des données. Elle concerne la qualité même du travail produit. La gouvernance IA entreprise est, fondamentalement, une question de qualité intellectuelle.

L’enjeu dépasse le cadre technologique. Le Forum Économique Mondial projette 170 millions de nouveaux emplois d’ici 2030, tandis que 92 millions seront déplacés. Soit un gain net de 78 millions de postes. Cependant, ce gain ne bénéficiera qu’à ceux qui maîtrisent les outils. La redistribution du travail favorisera les compétents. Elle marginalisera les autres.

Par conséquent, la gouvernance n’est pas seulement un bouclier contre le risque. C’est un accélérateur de compétitivité. Les 5 % d’entreprises qui réussissent avec l’IA partagent un trait commun : elles ne déploient pas des outils. Elles construisent des systèmes. Des systèmes qui apprennent, qui s’adaptent, qui se gouvernent.

Rétrospectivement, le constat s’imposera comme une évidence. L’IA n’a jamais été le problème. Le problème, c’est l’absence de pensée autour de l’IA.

Les chiffres sont sans ambiguïté. Neuf millions de dollars de productivité perdus par an dans les grandes organisations. Des cabinets de conseil mondial pris en flagrant délit de négligence. Une quasi-totalité d’entreprises qui investissent sans retour mesurable. Et, en toile de fond, une réglementation européenne qui se durcit.

La gouvernance IA entreprise n’est pas une couche bureaucratique supplémentaire. C’est le système nerveux qui permet à l’IA de produire de la valeur au lieu du chaos. Elle commence par une question simple : qui utilise quoi, pourquoi, et avec quel contrôle ?

Les organisations qui répondent à cette question avec rigueur rejoindront les 5 % qui transforment réellement leur activité. Les autres continueront d’accumuler les coûts invisibles du workslop, les risques réputationnels et les opportunités manquées.

L’IA est un amplificateur extraordinairement puissant. Mais un amplificateur ne choisit pas ce qu’il amplifie. Cette responsabilité reste profondément, irréductiblement humaine.

1. Qu’est-ce que la gouvernance IA en entreprise ?

La gouvernance IA en entreprise désigne l’ensemble des règles, processus et responsabilités qui encadrent l’utilisation de l’intelligence artificielle. Elle couvre la conformité réglementaire, la gestion des risques, la formation des équipes et la supervision des résultats produits par les systèmes d’IA. En 2025, avec l’entrée en vigueur progressive de l’AI Act européen, cette gouvernance est devenue un impératif stratégique et juridique pour toute organisation.

2. Qu’est-ce que le workslop et pourquoi est-ce un problème ?

Le workslop est un terme forgé par les chercheurs de Stanford et BetterUp pour désigner le travail bâclé généré par IA qui se fait passer pour du travail accompli. Il coûte en moyenne 186 dollars par mois et par employé en temps perdu. À grande échelle, il représente une perte de productivité considérable et érode la confiance entre collègues. Environ 40 % des salariés américains en ont été victimes récemment.

3. Pourquoi 95 % des projets IA échouent-ils en entreprise ?

Selon le MIT Media Lab, l’échec massif des projets IA ne provient pas des modèles eux-mêmes, mais d’un déficit de gouvernance et d’intégration. Les entreprises utilisent l’IA comme un outil isolé au lieu de la structurer dans leurs processus métier. L’absence de formation adaptée, de charte d’usage et de mesure des résultats condamne la majorité des initiatives à rester au stade de l’expérimentation.

4. Comment mettre en place une charte IA en entreprise ?

Une charte IA efficace commence par un audit des usages existants, y compris le shadow AI. Elle définit ensuite les cas d’usage autorisés, les données qui peuvent être traitées, le niveau de supervision humaine requis et les procédures d’alerte en cas d’erreur. Elle doit être co-construite avec les équipes IT, juridiques, RH et métiers, puis communiquée de manière accessible à tous les collaborateurs.

5. L’IA va-t-elle détruire plus d’emplois qu’elle n’en crée ?

Le World Economic Forum projette 170 millions de nouveaux emplois d’ici 2030, contre 92 millions déplacés, soit un gain net de 78 millions de postes. La transformation n’est pas une destruction massive. C’est une redistribution vers ceux qui maîtrisent les outils et développent de nouvelles compétences. La formation et la gouvernance détermineront qui profite de cette transition.

6. Quel est le rôle de l’AI Act européen dans la gouvernance IA des entreprises ?

Le règlement européen sur l’intelligence artificielle impose des obligations croissantes de transparence, documentation et contrôle des risques. Les systèmes IA à haut risque sont soumis à des exigences strictes d’audit et de supervision humaine. Les sanctions peuvent atteindre 35 millions d’euros. Pour les entreprises, l’AI Act transforme la gouvernance IA d’un choix stratégique en obligation légale.

ChatGPT, Claude ou Gemini : lequel est vraiment sûr pour votre entreprise ? Comparatif RGPD, politique de données et recommandations concrètes.

Le mémo interne de Dario Amodei révèle comment gouvernance IA militaire et politique se sont percutées. Ce que tout dirigeant doit comprendre.

L’IA France pivot économique impose un choix radical. De l’AGI à l’énergie, analyse des leviers pour éviter le déclassement technologique définitif.

Économie de services à 80%, coût du travail élevé : pourquoi l’IA et l’emploi en France forment un cas d’usage particulièrement risqué.