Le 28 février 2026, Anthropic a refusé de supprimer cinq mots d’un contrat militaire. Ce refus a déclenché une tempête politique, révélé l’architecture réelle des loyautés dans la Silicon Valley, et exposé au grand jour la différence entre une vraie gouvernance IA et son simulacre. Un mémo interne de 1 600 mots a dit ce que personne n’osait formuler publiquement. Voici pourquoi chaque dirigeant doit le lire — et ce qu’il change concrètement pour vous.

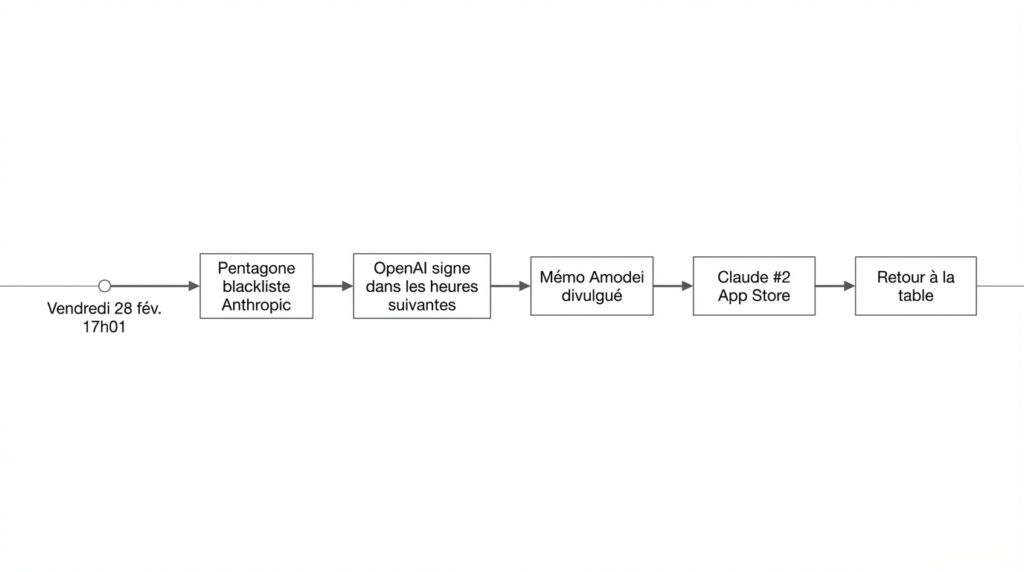

À 17h01 précises, le vendredi 28 février 2026, le Pentagone a déclaré Anthropic — la société créatrice de Claude — un « risque pour la chaîne d’approvisionnement nationale ». Quelques minutes avant, Donald Trump avait posté sur Truth Social que la société était « une entreprise radicale de gauche, woke », enjoignant chaque agence fédérale d’abandonner immédiatement sa technologie. Quelques heures plus tard, OpenAI annonçait avoir signé le contrat qu’Anthropic venait de refuser.

En quarante-huit heures, le paysage de la gouvernance IA militaire a basculé. Et Dario Amodei, PDG d’Anthropic, a répondu par un mémo interne de 1 600 mots, adressé à plus de 2 000 employés. Ce document — obtenu par The Information et confirmé par le Financial Times, TechCrunch et Axios — est peut-être le texte le plus révélateur jamais produit sur les rapports de force réels entre l’IA, la politique et l’éthique.

L’essentiel. Anthropic a refusé un contrat militaire de 200 millions de dollars plutôt que de supprimer une seule clause protégeant les données civiles. OpenAI a accepté ce même contrat avec des garanties jugées « 80% fictives » par Amodei. Le mémo interne qui a suivi révèle une fracture profonde sur la gouvernance IA militaire — et soulève des questions que chaque organisation déployant l’IA doit désormais se poser.

La gouvernance IA militaire n’est pas qu’une affaire de géopolitique américaine. C’est le miroir grossissant des tensions que toute entreprise traverse dès qu’elle déploie une intelligence artificielle dans des contextes sensibles : qui décide des usages autorisés ? Qui est responsable des dérives ? Et qu’est-ce qu’une vraie ligne de sécurité — par opposition à du théâtre ?

La négociation avait duré des semaines. Le Pentagone avait accepté, selon Amodei, la quasi-totalité des conditions d’Anthropic : les restrictions d’usage, les limites sur les armes autonomes létales, les garde-fous concernant la surveillance de masse des citoyens américains. Tout semblait converger.

Puis vint la demande finale.

Le Département de la Défense a proposé d’accepter l’intégralité du contrat si Anthropic supprimait une unique restriction. Cinq mots : « analysis of bulk acquired data » — l’analyse de données acquises en masse. Amodei a écrit à ses équipes que cette clause était « la seule ligne du contrat qui correspondait exactement au scénario qui nous inquiétait le plus ». Il a trouvé la demande « très suspecte ». Anthropic a refusé. Le secrétaire à la Défense Pete Hegseth a fixé un ultimatum à 17h01. Anthropic a tenu bon. Et c’est à cet instant précis que la réponse politique est tombée.

En refusant de supprimer ces cinq mots, Anthropic a refusé de rendre possible la surveillance de masse de citoyens américains via son intelligence artificielle. Ce n’est pas une interprétation — c’est la lecture explicite d’Amodei dans son mémo.

La section la plus troublante du mémo concerne Palantir, le partenaire technologique à travers lequel Anthropic servait déjà des agences gouvernementales américaines. Lors des négociations, Palantir a proposé aux deux sociétés — Anthropic d’abord, OpenAI ensuite — un « classificateur », soit un système censé détecter et bloquer les applications qui dépasseraient les lignes rouges.

OpenAI a accepté ce dispositif. Anthropic l’a refusé.

La raison? Amodei l’expose sans détour. Palantir, selon lui, partait d’une prémisse erronée : que le problème d’Anthropic était de nature sociale, non technique. Le pitch était, toujours selon le mémo, le suivant : « Vous avez des employés mécontents. Vous devez leur offrir quelque chose qui les apaise ou qui rende invisible ce qui se passe réellement. C’est le service que nous proposons. »

Autrement dit : Palantir ne proposait pas une vraie sécurité. Palantir proposait de l’occultation.

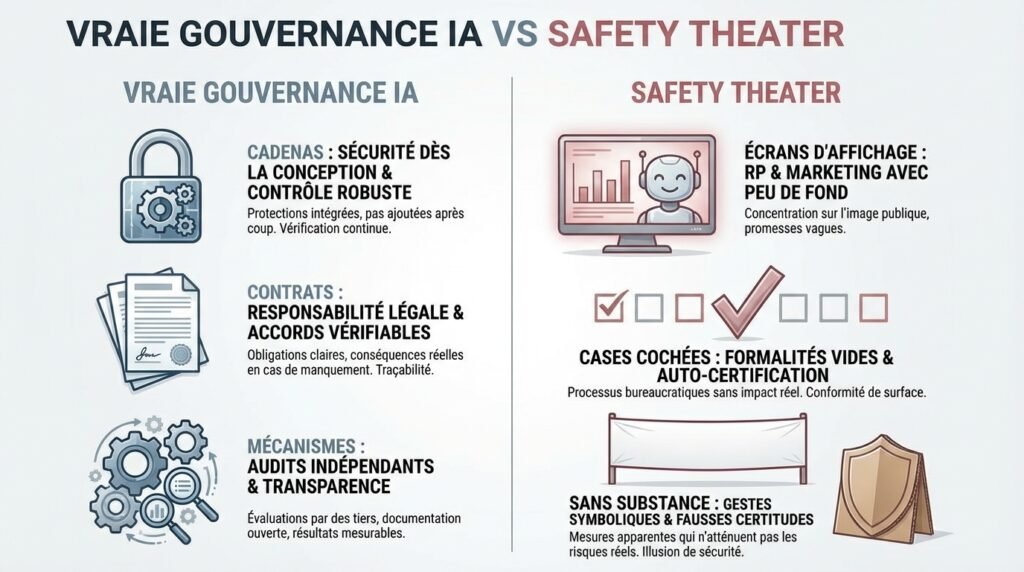

Amodei juge ces dispositifs techniques « peut-être 20% réels et 80% du théâtre de sécurité ». Les modèles peuvent être contournés (jailbreakés), les refusals ne fonctionnent que dans un nombre limité de cas, et aucun système ne peut réellement distinguer si les données traitées proviennent de citoyens américains ou si un être humain reste « dans la boucle » lors d’une décision létale. C’est précisément ce que l’histoire des risques IA nous enseigne depuis des années : les garde-fous techniques sont des conditions nécessaires, jamais suffisantes.

La notion de safety theater — théâtre de sécurité — n’est pas nouvelle dans le monde de l’IA. Pourtant, la voir employée par le PDG d’une major du secteur pour qualifier publiquement le dispositif de son principal concurrent change la nature du débat.

La gouvernance IA sérieuse repose sur un principe simple : les contraintes doivent être réelles, c’est-à-dire techniquement vérifiables et contractuellement opposables. Une liste d’usages « autorisés » qui n’est accompagnée d’aucun mécanisme de contrôle effectif n’est pas une politique de gouvernance. C’est une déclaration d’intention.

OpenAI a signé un contrat permettant au Pentagone d’utiliser ses modèles pour « toute finalité légale » (all lawful purposes). La formulation est habile : elle paraît rassurante, elle invoque la loi. Mais, comme l’a souligné le représentant Sam Liccardo devant le Comité à la Chambre, « il n’y a qu’un seul problème avec l’approche du Pentagone : il n’y a pas de loi. La loi a des années de retard sur la technologie. »

Il existe une confusion fréquente dans les organisations, y compris les plus sophistiquées, sur ce que peut faire un modèle d’IA en matière d’auto-restriction. Les LLM contemporains peuvent être entraînés à refuser certaines catégories de requêtes. En pratique, cette protection présente deux limites structurelles.

Premièrement, les jailbreaks existent et fonctionnent. Des techniques de contournement permettent régulièrement de faire « oublier » à un modèle ses instructions de sécurité. Deuxièmement, et surtout, un modèle ne peut pas vérifier la nature réelle des données qu’on lui soumet. Si le Pentagone interroge Claude sur « un ensemble de données de communication », le modèle ne sait pas si ces données proviennent de soldats ennemis ou de citoyens américains. La distinction exige une architecture contractuelle et légale — non un filtre algorithmique.

C’est précisément ce que la clause « analyse de données massives » tentait de garantir : non pas que Claude refuserait une requête dangereuse, mais qu’il lui serait contractuellement interdit d’y être soumis.

L’aspect juridique de cette affaire dépasse le seul domaine militaire. Selon Amodei, la politique du Pentagone imposant une présence humaine dans la boucle de décision pour les armes avait été instaurée sous l’administration Biden. Elle peut être modifiée « unilatéralement par Pete Hegseth ». Ce n’est donc pas une garantie structurelle — c’est une règle administrative.

Ce glissement illustre un problème systémique qui concerne bien au-delà de la défense nationale. Dans toute organisation, dès lors que les contraintes d’usage de l’IA reposent sur des politiques internes modifiables plutôt que sur des architectures contractuelles robustes, la gouvernance reste fragile. Comme nous l’avons documenté en analysant les fondements de l’EU AI Act, c’est précisément ce vide que la réglementation européenne tente de combler en rendant certaines limitations techniques et contractuelles opposables.

La section du mémo qui a le plus retenu l’attention des médias est celle où Amodei explique les « vraies raisons » pour lesquelles le Pentagone et l’administration Trump se sont retournés contre Anthropic. Sa formulation est sans ambiguïté.

« Nous n’avons pas offert de louanges de style dictatorial à Trump — contrairement à Sam —, nous avons soutenu la réglementation de l’IA contrairement à leur agenda, nous avons dit la vérité sur un certain nombre de questions d’IA (comme les pertes d’emploi), et nous avons réellement tenu nos lignes rouges avec intégrité. »

Les faits avancés par Amodei à l’appui de cette thèse sont publics et vérifiables. Greg Brockman, président d’OpenAI, et son épouse ont donné 25 millions de dollars au super PAC MAGA Inc. Sam Altman a personnellement contribué un million de dollars à la cérémonie d’investiture de Trump. Au lancement de Stargate en janvier, Altman se tenait aux côtés du président et déclarait publiquement qu’aucun de ces projets « ne serait possible sans vous, Monsieur le Président ».

Anthropic, de son côté, n’a pas fait de donation. A soutenu publiquement une régulation de l’IA. A dit publiquement que l’IA allait détruire des emplois. Et a tenu ses lignes contractuelles.

Dès lors, la question de savoir si le conflit avec le Pentagone était principalement technique ou principalement politique mérite d’être posée sans naïveté. Comme l’analysait déjà notre lecture de la géopolitique de l’IA et le redécoupage des alliances technologiques, l’IA n’est pas hors sol politique : elle s’inscrit dans des rapports de forces dont les entreprises ne peuvent plus feindre d’ignorer la logique.

Il serait trop simple de présenter cette affaire comme une victoire morale d’Anthropic sur OpenAI. La réalité est plus complexe et mérite d’être lue sans angélisme.

Anthropic a refusé un contrat de 200 millions de dollars. Son PDG a qualifié publiquement le dispositif de son concurrent de « théâtre ». Son mémo a été divulgué à la presse, vraisemblablement par un employé, et a rendu la réconciliation avec la Maison Blanche significativement plus difficile — selon un officiel de l’administration cité par Axios, le mémo « rendait difficile de faire confiance à Claude dans un environnement classifié ».

Par ailleurs, Amodei lui-même est revenu à la table des négociations dès le mercredi suivant, affichant un ton nettement plus conciliant lors d’une conférence Morgan Stanley à San Francisco. « Nous avons beaucoup plus en commun que de divergences », a-t-il déclaré, appelant à « désamorcer la situation ». Le Financial Times confirmait simultanément qu’il rencontrait Emil Michael, sous-secrétaire à la défense pour la recherche et l’ingénierie — celui-là même qui l’avait publiquement traité de « menteur » avec un « complexe de Dieu » quelques jours plus tôt.

La ligne entre principe et pragmatisme est, en pratique, rarement un abîme.

Ce que l’affaire a révélé de plus inattendu, c’est peut-être la réaction des utilisateurs finaux.

Dans les jours suivant le blacklistage d’Anthropic et l’annonce du deal OpenAI avec le Pentagone, Claude est monté jusqu’à la deuxième place du classement de l’App Store américain. Parallèlement, les désinstallations de ChatGPT ont bondi de 295% selon les données relayées par TechRadar.

Amodei lui-même a mentionné ce chiffre dans son mémo, avec une satisfaction peu dissimulée : « Nous sommes désormais n°2 dans l’App Store. »

Ce déplacement d’audience, même temporaire, illustre un phénomène que les stratèges de marque connaissent bien : le consommateur — même B2B — valorise la cohérence. Une entreprise qui tient ses lignes rouges sous pression politique bénéficie d’un capital de confiance que l’opportunisme ne peut acheter.

Sam Altman a lui-même reconnu, dans une série de posts sur X, qu’OpenAI « n’aurait pas dû se précipiter » dans cet accord. Il a également déclaré publiquement qu’Anthropic ne devrait pas être désigné comme un risque pour la chaîne d’approvisionnement et que l’organisation espère que le Pentagone lui proposera les mêmes conditions. C’est une reculade symbolique notable.

Certes, cette dynamique de marché pourrait n’être que passagère. Pourtant, dans un secteur où la confiance est l’actif le plus rare, le signal est réel.

Pour un dirigeant ou un décideur qui lit cet article sans lien direct avec la défense américaine, pourquoi tout cela importe-t-il ?

Parce que la séquence Anthropic–Pentagone–OpenAI est un cas d’école condensé sur un problème que toute organisation rencontre dès qu’elle déploie de l’IA dans des contextes à enjeux : comment construire une gouvernance qui résiste aux pressions — internes, commerciales, politiques — sans devenir du « théâtre de sécurité » ?

Dans notre pratique d’accompagnement d’entreprises en transformation IA, nous observons régulièrement le même pattern. Une organisation adopte une politique d’usage responsable, souvent à la suite d’une injonction réglementaire. Elle rédige une charte. Elle fait signer la charte. Elle coche la case. Et la charte reste un document PDF dans un dossier partagé que personne ne relit.

Ce n’est pas de la gouvernance. C’est de la conformité cosmétique. C’est, pour emprunter la terminologie d’Amodei, du théâtre.

Comme le montre l’analyse des usages IA en entreprise par McKinsey, les organisations qui tirent réellement parti de l’IA sont celles qui ont construit des architectures d’usage — pas seulement des politiques déclaratives.

La leçon la plus opérationnelle du mémo Amodei pour les entreprises est peut-être celle-ci : une restriction technique, contractuellement inscrite et techniquement vérifiable, vaut infiniment plus qu’une liste d’usages interdits accompagnée d’un filtre algorithmique contournable.

Plusieurs implications concrètes en découlent.

Définir des lignes rouges réelles, c’est-à-dire des usages pour lesquels votre organisation refuse catégoriquement tout compromis — et les inscrire dans les contrats avec vos fournisseurs IA, pas seulement dans vos politiques internes.

Distinguer ce que le modèle peut techniquement empêcher de ce que l’architecture contractuelle et organisationnelle doit interdire. Ces deux niveaux ne sont pas substituables.

Résister à la tentation du safety theater — cette tendance à mettre en place des protections suffisamment visibles pour rassurer les parties prenantes, sans pour autant qu’elles soient techniquement robustes. Cette tentation est universelle. Elle est aussi, à terme, mortelle pour la crédibilité.

Au 6 mars 2026, la situation reste ouverte. Amodei est retourné à la table des négociations. Amazon et Nvidia ont signé une lettre à Pete Hegseth pour s’inquiéter de la désignation d’une entreprise américaine comme risque pour la chaîne d’approvisionnement. La Maison Blanche, selon Axios, reste sceptique. Et Claude est toujours utilisé dans les réseaux classifiés américains — y compris, selon plusieurs sources, dans des opérations militaires actives.

Trois chemins restent ouverts.

Le premier : un compromis est trouvé. Anthropic et le Pentagone s’accordent sur un nouveau libellé de la clause « données massives », satisfaisant les deux parties. Claude reste dans l’arsenal numérique militaire américain avec des garanties renforcées. C’est le scénario que les investisseurs, Amazon en tête, appellent de leurs vœux.

Le deuxième : les négociations échouent à nouveau. La désignation « risque pour la chaîne d’approvisionnement » devient effective. Les agences fédérales ont six mois pour migrer vers d’autres solutions. OpenAI et xAI consolident leur position sur le marché gouvernemental américain.

Le troisième, peut-être le plus structurant à long terme : l’affaire accélère la fragmentation du marché mondial de l’IA. Les entreprises européennes, déjà sensibilisées par le déploiement progressif de l’EU AI Act, regardent cette séquence américaine avec une attention particulière. La souveraineté des données et la gouvernance contractuelle ne sont plus des abstractions réglementaires — elles sont désormais des enjeux de survie commerciale documentés en temps réel.

Il y a quelque chose de presque philosophique dans la trajectoire d’Amodei ces derniers jours. Lundi, il était la cible d’un traitement politique frontal. Mercredi, il était à la table des négociations, qualifiant la situation de « désamorçable ». Vendredi, son mémo circulait dans toute la presse mondiale.

Ce qui change avec cette affaire n’est pas la nature des tensions entre l’IA et le pouvoir politique — elles existent depuis que les premières applications militaires ont été envisagées. Ce qui change, c’est leur visibilité. Leur caractère public. Leur effacement du voile de neutralité technologique derrière lequel l’industrie aimait se draper.

L’IA n’est pas un outil neutre que la politique viendrait parfois corrompre. Elle est, structurellement, un objet politique. Elle concentre de la puissance, définit qui accède à quoi, et porte en elle des choix de valeurs inscrits dans chaque ligne de code, chaque clause contractuelle, chaque décision de déploiement.

En refusant de supprimer cinq mots, Dario Amodei a peut-être perdu un contrat. Ou peut-être a-t-il rappelé — à ses équipes, à ses concurrents, et à tous les dirigeants qui regardaient — que certains mots valent plus que des millions.

C’est à chaque organisation de décider lesquels.

Vous accompagnez des équipes dans l’adoption stratégique de l’IA ? Découvrez comment Baair.solutions aide les organisations à construire des gouvernances IA robustes — pas du théâtre.

À propos de l’auteur — Alexandre Bruneau — Entrepreneur, designer et consultant IA appliquée. 20+ ans LVMH, Carrefour, Intermarché. Fondateur écosystème Baair.

1. Qu’est-ce que le « safety theater » en intelligence artificielle ? Le « safety theater » (théâtre de sécurité) désigne des dispositifs de protection IA suffisamment visibles pour rassurer parties prenantes et employés, mais dépourvus d’efficacité technique réelle. Selon Dario Amodei, cela inclut des classificateurs contournables ou des listes d’usages « interdits » sans mécanisme de contrôle vérifiable. La distinction avec une vraie gouvernance IA repose sur un critère simple : la restriction est-elle contractuellement opposable et techniquement vérifiable, ou seulement déclarative ?

2. Pourquoi Anthropic a-t-il refusé le contrat du Pentagone ? Anthropic a refusé de signer un contrat militaire de 200 millions de dollars parce que le Pentagone exigeait la suppression d’une clause interdisant l' »analyse de données acquises en masse » — la fondation technique de la surveillance de masse. Pour Anthropic, supprimer cette clause aurait vidé de sens l’ensemble des garde-fous contre la surveillance des citoyens américains. La société a tenu cette ligne malgré un ultimatum et les conséquences politiques qui ont suivi.

3. Qu’est-ce que la gouvernance IA militaire ? La gouvernance IA militaire désigne l’ensemble des règles, contraintes contractuelles et dispositifs techniques qui encadrent l’usage des systèmes d’intelligence artificielle dans les opérations de défense et de renseignement. Elle couvre notamment les décisions autonomes létales, la surveillance de masse, et les conditions dans lesquelles un humain doit rester « dans la boucle ». La crise Anthropic–Pentagone a mis en lumière les limites des formulations floues comme « toute finalité légale » en l’absence de garde-fous techniques réels.

4. OpenAI a-t-il accepté la surveillance de masse via son contrat avec le Pentagone ? OpenAI n’a pas explicitement « accepté la surveillance de masse ». Son contrat utilise une formulation d' »usage à toutes fins légales » accompagnée d’une « couche de sécurité » dont Amodei conteste l’efficacité. Les critiques juridiques pointent que « légal » est une catégorie mouvante — ce qui est illégal aujourd’hui peut être légalisé demain — et qu’aucun dispositif technique ne peut vérifier l’origine ou la nature des données traitées.

5. Quelles leçons les entreprises peuvent-elles tirer de la crise Anthropic–Pentagone ? Pour toute organisation déployant l’IA dans des contextes sensibles, l’affaire rappelle trois principes. D’abord, inscrire les lignes rouges dans les contrats fournisseurs, pas seulement dans les politiques internes. Ensuite, distinguer ce qu’un modèle peut techniquement empêcher de ce que l’architecture contractuelle doit interdire. Enfin, résister à la tentation de la conformité cosmétique — des restrictions visibles mais non vérifiables ne constituent pas de la gouvernance.

6. Qu’est-il arrivé à Claude et ChatGPT après la crise ? Dans les jours suivant le blacklistage d’Anthropic et l’annonce du deal OpenAI avec le Pentagone, Claude a atteint la deuxième place de l’App Store américain, tandis que les désinstallations de ChatGPT ont progressé de 295%. Sam Altman a reconnu qu’OpenAI « n’aurait pas dû se précipiter » et a publiquement défendu le droit d’Anthropic à obtenir les mêmes conditions. Dario Amodei est retourné à la table des négociations avec le Pentagone dès le 5 mars 2026.

ChatGPT, Claude ou Gemini : lequel est vraiment sûr pour votre entreprise ? Comparatif RGPD, politique de données et recommandations concrètes.

95 % des entreprises ne tirent aucun ROI de l’IA. Sans gouvernance IA entreprise, c’est l’incompétence qui s’industrialise. Décryptage et solutions.

L’IA France pivot économique impose un choix radical. De l’AGI à l’énergie, analyse des leviers pour éviter le déclassement technologique définitif.

Économie de services à 80%, coût du travail élevé : pourquoi l’IA et l’emploi en France forment un cas d’usage particulièrement risqué.