ChatGPT entraîne ses modèles sur vos données, sauf si vous désactivez l’option. Gemini croise vos interactions avec votre compte Google. Claude se positionne comme le plus transparent sur la non-utilisation des données professionnelles. Mais dans les trois cas, la frontière entre sécurité et exposition passe par une ligne que beaucoup d’entreprises ignorent : la différence entre plan gratuit et plan Enterprise. Ce comparatif vous donne les clés pour choisir avec discernement.

Il y a une question que trop peu de dirigeants posent avant de déployer une IA dans leur entreprise. Non pas « est-ce efficace ? », ni même « est-ce rentable ? ». La vraie question, celle qui conditionne tout le reste, est beaucoup plus simple : où vont mes données ?

En 2026, la majorité des PME françaises utilisent au moins un outil d’IA générative dans leur fonctionnement quotidien. ChatGPT, Claude, Gemini — ces trois noms sont devenus aussi familiers que les logiciels de bureautique. Pourtant, la sécurité IA en entreprise reste un angle mort stratégique. Les utilisateurs tapent des briefs clients, des analyses financières, des stratégies confidentielles. Et ils ne savent pas, concrètement, ce qu’il advient de ces informations.

Cet article démonte les politiques réelles de chaque plateforme. Il compare les garanties disponibles par niveau de plan. Et il livre les recommandations concrètes pour choisir l’outil adapté à votre contexte et à votre exposition réglementaire.

L’essentiel. Les trois grandes plateformes IA ne traitent pas vos données de la même manière. ChatGPT entraîne ses modèles sur les conversations des utilisateurs gratuits, sauf désactivation manuelle. Claude se positionne comme le plus transparent sur la non-utilisation des données professionnelles. Gemini soulève des questions spécifiques liées à l’intégration profonde dans l’écosystème Google. Dans tous les cas, les plans Enterprise offrent des garanties incomparablement supérieures aux versions gratuites — une distinction que les PME ignorent trop souvent à leurs risques.

Qu’est-ce que la sécurité IA en entreprise ? La sécurité IA en entreprise désigne l’ensemble des garanties offertes par un fournisseur d’intelligence artificielle concernant le traitement, la conservation et l’utilisation des données transmises lors des interactions. Elle couvre la politique d’entraînement des modèles, la conformité RGPD, les certifications de sécurité, le chiffrement des données et les mécanismes d’audit accessibles aux organisations.

En 2019, un avocat américain citait devant un tribunal des jurisprudences entières générées par ChatGPT. Toutes étaient fictives. L’affaire a fait le tour du monde. Pourtant, le risque juridique réel lié aux IA d’entreprise n’est pas là.

Il est dans le flux inverse. Non pas dans ce que l’IA invente — mais dans ce que vous lui confiez.

Chaque jour, des équipes entières partagent avec des modèles IA des informations qui ne devraient jamais quitter le périmètre de l’entreprise. Des comptes-rendus de réunions stratégiques. Des fichiers de paie. Des analyses concurrentielles. Des contrats en cours de négociation. Ces données transitent par des serveurs dont la localisation, les politiques de rétention et les usages potentiels restent largement méconnus.

La sécurité IA en entreprise n’est pas un sujet réservé aux DSI. C’est une responsabilité de direction. En France, le RGPD impose aux entreprises de s’assurer que leurs sous-traitants — y compris les fournisseurs d’IA — offrent des garanties adéquates de protection des données personnelles. Et l’EU AI Act, dont les obligations s’appliquent progressivement depuis 2024, renforce ces exigences pour les usages à risque.

Or, en accompagnant des dirigeants de PME dans leur transition IA, nous observons systématiquement la même réalité : l’outil choisi l’a été pour ses performances, jamais pour ses garanties de confidentialité. Le résultat est une exposition silencieuse, difficile à quantifier mais réelle.

Dès lors, comprendre ce que font réellement ChatGPT, Claude et Gemini de vos données n’est plus optionnel. C’est une décision stratégique.

ChatGPT reste, en 2026, la plateforme la plus utilisée dans le monde professionnel. Plus de 500 millions d’utilisateurs actifs, une intégration dans des milliers d’outils via l’API OpenAI, une présence dans 85 % des entreprises du Fortune 500 via les plateformes Microsoft. Sa domination est incontestable.

Sa politique de données, en revanche, mérite une lecture attentive.

Pour les utilisateurs des offres business — ChatGPT Team, ChatGPT Enterprise et l’API — OpenAI n’utilise pas les données pour entraîner ses modèles par défaut. Les organisations sont exclues de ce partage sauf opt-in explicite de leur part. C’est la bonne nouvelle.

La mauvaise est symétrique. Pour le plan gratuit et les plans payants individuels (hors Business), les données sont utilisées par défaut pour entraîner les modèles OpenAI. Il faut désactiver manuellement cette option dans les paramètres. Une démarche que la grande majorité des utilisateurs n’effectue jamais, faute d’en avoir connaissance.

La distinction est fondamentale. Dans une PME sans politique IA formalisée, il est fréquent que des collaborateurs utilisent leurs comptes personnels — parfois gratuits — pour des tâches professionnelles. Ils pensent utiliser « ChatGPT l’outil d’entreprise ». En réalité, leurs échanges alimentent potentiellement les futurs modèles d’OpenAI.

Il existe un second angle mort, plus structurel. OpenAI est une entreprise américaine. Ses serveurs sont majoritairement localisés aux États-Unis. Or, le Cloud Act de 2018 autorise les autorités américaines à requérir l’accès aux données stockées par des entreprises US, y compris sur des serveurs étrangers, et ce indépendamment du consentement de l’entreprise concernée.

En juin 2025, OpenAI a divulgué l’existence d’une décision de justice imposant la conservation de certaines données utilisateurs dans le cadre d’un litige en cours. Ce type d’événement illustre concrètement ce que les juristes nomment le « risque de disclosure » — la possibilité qu’un tiers accède légalement à des données que vous pensiez protégées.

La politique de sécurité de ChatGPT décrit ses protections comme des « mesures techniques, administratives et organisationnelles commercialement raisonnables » — une formulation vague qui offre peu de garanties spécifiques ou d’assurances concrètes.

Pour les entreprises européennes soumises au RGPD, cette combinaison — serveurs américains, Cloud Act, formulations vagues — constitue un risque de conformité réel. Non rédhibitoire, mais documenté. Et non géré dans la majorité des déploiements observés.

Anthropic, créateur de Claude, a fait de la sécurité des données un argument de positionnement explicite. Ce n’est pas un hasard : l’entreprise a été fondée par d’anciens membres d’OpenAI avec une mission déclarée de développement responsable de l’IA. Cette posture se traduit directement dans les politiques de données.

Claude Team et Enterprise offrent des garanties de non-entraînement sur les données, avec en plus des logs d’audit détaillés. Cette politique s’applique par défaut, sans configuration particulière — un argument fort pour les entreprises soumises au RGPD ou manipulant des données sensibles.

Concrètement, cela signifie qu’un utilisateur de Claude for Work ou Claude Enterprise n’a pas besoin de chercher un paramètre à désactiver. La protection des données professionnelles est le mode par défaut, et non l’exception.

Claude accorde une attention particulière à la protection des données utilisateurs. Leur utilisation est limitée à l’amélioration du service, sans exploitation commerciale ni utilisation pour l’entraînement des modèles. Les données ne sont pas utilisées pour entraîner le modèle sans consentement explicite.

Il convient néanmoins de signaler une nuance importante, documentée en 2025. Anthropic a annoncé que les conversations des utilisateurs grand public seront utilisées pour l’entraînement sauf opt-out de leur part, avec une rétention prolongée pour ceux qui opt-in. Cette évolution concerne spécifiquement le niveau grand public de Claude.ai — pas les déploiements Enterprise, gouvernementaux ou via API, qui restent exclus par défaut.

La distinction entre usages grand public et usages professionnels est ici encore décisive.

Au-delà des déclarations de principe, les certifications constituent les preuves vérifiables d’un niveau de sécurité réel.

Claude adopte une posture de sécurité plus rigoureuse, adossée à des certifications sectorielles reconnues telles que SOC 2 Type II et ISO 42001. La norme SOC 2 Type II atteste d’un audit indépendant des contrôles de sécurité sur une période de six à douze mois — bien plus exigeant qu’une déclaration ponctuelle. L’ISO 42001 est la première norme internationale spécifiquement dédiée aux systèmes de management de l’IA.

Des entreprises du secteur financier comme Nordea ou BlackRock, ainsi que des acteurs de la cybersécurité comme HackerOne et Palo Alto Networks, ont adopté Claude spécifiquement pour ses outputs plus prudents et honnêtes. Ces références ne sont pas anodines : ce sont précisément les secteurs soumis aux régulations les plus strictes en matière de confidentialité des données.

Claude Enterprise propose également le SSO via SAML, la gestion fine des permissions et des logs d’audit détaillés. Ces fonctionnalités de traçabilité sont essentielles dans les environnements soumis à des audits réguliers.

Gemini présente un profil de risque distinct. Son point fort est aussi son point de vulnérabilité : une intégration profonde dans l’écosystème Google. Pour une entreprise déjà organisée autour de Gmail, Drive, Docs et Meet, Gemini offre une fluidité incomparable. Les données sont déjà là. L’IA y accède directement. La productivité grimpe immédiatement.

Néanmoins, cette intégration appelle une vigilance spécifique.

Gemini est pleinement intégré dans l’écosystème Google. Les interactions sont systématiquement associées à l’identité Google de l’utilisateur, et ces données sont potentiellement croisées avec d’autres services Google. Les serveurs de traitement sont pour la plupart situés hors d’Europe, initialement aux États-Unis — loin d’une conformité stricte avec le RGPD.

Google indique que les interactions avec Gemini sont enregistrées par défaut et utilisées pour améliorer le service. Des évaluateurs humains peuvent lire certaines conversations — Google le reconnaît et propose une option pour refuser la « relecture humaine » dans les paramètres d’activité.

Cette dernière information mérite d’être soulignée. La possibilité qu’un être humain lise une conversation tenue dans un outil professionnel est un risque que beaucoup d’entreprises ne mesurent pas.

Là encore, la distinction entre version grand public et version professionnelle est fondamentale.

Gemini Business reste l’option la plus économique pour les PME sur Google Workspace, à environ 2 400 dollars par an pour dix utilisateurs. Sur le plan de la sécurité, Gemini Enterprise s’appuie sur l’infrastructure Google Cloud avec ses certifications SOC 2 et ISO 27001, et une gestion centralisée via la console d’administration Google Workspace.

Google a également annoncé Gemini Vault — une version de Gemini avec récupération de données soumise à permissions utilisateur, s’inscrivant dans l’espace des solutions de protection des données avancées. Les détails restent en cours de déploiement, mais le signal stratégique est clair : Google entend rassurer les entreprises soucieuses de confidentialité.

En revanche, la question de la localisation des données en Europe reste un sujet ouvert pour les entreprises françaises les plus exigeantes sur la souveraineté numérique. Des acteurs comme Mistral (hébergé en Europe) ou des solutions déployables en local offrent un meilleur contrôle des données sensibles pour les grandes entreprises et les gouvernements exigeant une transparence complète et un alignement sur la réglementation européenne.

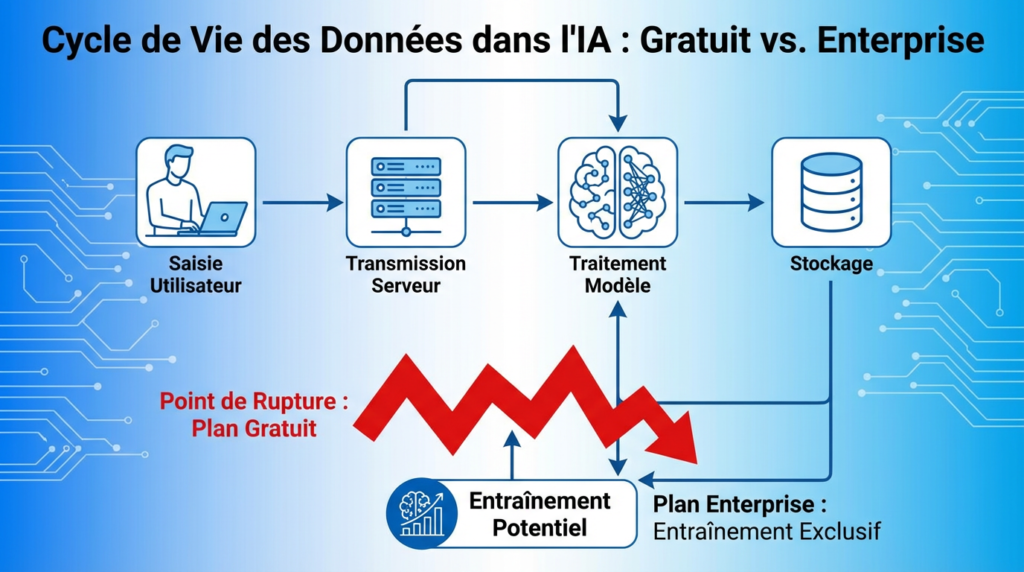

Avant tout comparatif technique, une règle absolue s’impose. Pour tout usage professionnel impliquant des données sensibles, les plans gratuits et les plans individuels sont à proscrire. Cette règle vaut pour les trois plateformes sans exception.

La différence entre un plan gratuit et un plan Enterprise n’est pas seulement fonctionnelle. Elle est réglementaire. Seuls les plans professionnels incluent les Accords de Traitement des Données (DPA) requis par le RGPD, les garanties de non-entraînement sur les données, et les outils d’administration permettant une gouvernance centralisée.

Or, au contact de PME en cours de déploiement IA, nous observons une réalité préoccupante : des collaborateurs qui utilisent leur compte Claude.ai personnel ou leur compte ChatGPT gratuit pour des tâches professionnelles quotidiennes. Ils pensent utiliser « l’IA de l’entreprise ». En réalité, ils opèrent dans un cadre sans garanties.

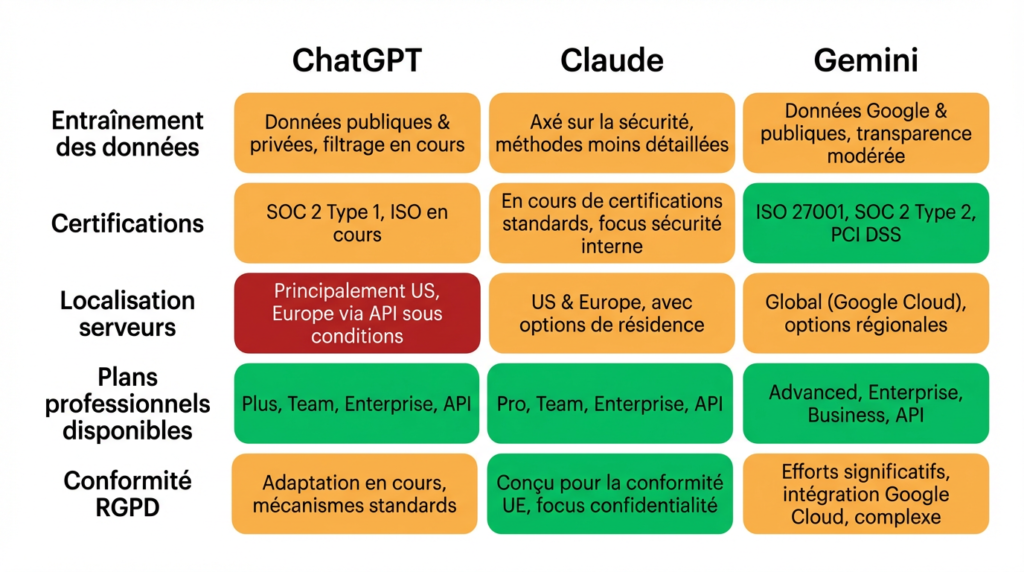

Pour synthétiser les différences essentielles entre les trois plateformes :

Sur la politique d’entraînement : ChatGPT gratuit entraîne ses modèles par défaut (opt-out disponible) ; ChatGPT Team/Enterprise exclut les données par défaut. Claude grand public a évolué vers l’opt-out en 2025 ; Claude Team/Enterprise exclut les données par défaut. Gemini enregistre les interactions par défaut sur les plans grand public ; Gemini Business/Enterprise offre des garanties contractuelles.

Sur la localisation des données : les trois plateformes hébergent principalement aux États-Unis, avec des implications Cloud Act pour les données européennes. Seule Mistral offre un hébergement européen natif.

Sur les certifications : Claude se distingue par SOC 2 Type II et ISO 42001. Microsoft Copilot dispose du panel de certifications le plus complet (HIPAA, FedRAMP). ChatGPT Enterprise et Gemini Enterprise couvrent SOC 2 et ISO 27001.

Sur la transparence : Claude communique publiquement les détails de sa politique de sécurité de manière plus explicite que ses concurrents, selon les analyses indépendantes disponibles.

Pour les entreprises des secteurs réglementés, les exigences vont au-delà du RGPD standard. Un cabinet d’avocats, une clinique privée ou une société de gestion d’actifs ne peuvent se contenter des garanties de base.

Copilot bénéficie de l’ensemble des certifications Microsoft Azure : SOC 2 Type II, ISO 27001, HIPAA, FedRAMP. C’est l’option la plus certifiée pour les grandes entreprises soumises à des audits réguliers. Pour ces environnements, Claude Enterprise propose les logs d’audit détaillés, le SSO SAML et la gestion des permissions — des fonctionnalités de traçabilité qui simplifient la démonstration de conformité lors des audits.

Dès lors, la recommandation pour les secteurs réglementés est claire : évaluer le panel de certifications requis avant de choisir la plateforme, et vérifier systématiquement l’existence d’un DPA signé avec le fournisseur.

Choisir l’outil le plus sécurisé n’est que la moitié du travail. L’autre moitié est interne. Elle concerne la gouvernance : comment encadrer l’usage de l’IA pour que les protections contractuelles se traduisent en pratiques réelles.

Une charte d’usage IA formalise trois dimensions essentielles. D’abord, les outils autorisés par fonction : tous les collaborateurs n’ont pas les mêmes besoins, ni les mêmes expositions au risque. Ensuite, les catégories de données qui ne doivent jamais être partagées avec une IA externe : données personnelles de clients, informations financières confidentielles, propriété intellectuelle sensible. Enfin, le processus de validation des contenus générés — pour éviter ce que les chercheurs de Stanford et BetterUp ont nommé le « workslop », ce travail bâclé généré par IA sans relecture, qui coûte en moyenne 186 dollars par mois et par collaborateur.

Notre analyse approfondie de la gouvernance IA en entreprise détaille les mécanismes concrets pour construire ce cadre d’usage, en tenant compte des contraintes spécifiques des PME françaises.

L’EU AI Act introduit une hiérarchie de risques qui s’applique aux usages de l’IA, pas seulement aux fournisseurs. Une entreprise qui déploie une IA pour prendre des décisions affectant des collaborateurs — évaluation de performance, affectation de tâches, filtrage de candidatures — peut se retrouver dans la catégorie « haut risque ». Les obligations de transparence et de documentation sont alors significatives.

Pour les usages courants — rédaction, synthèse, analyse de données — les contraintes restent modérées. Néanmoins, la traçabilité des outils utilisés et des données traitées devient un réflexe à acquérir. L’EU AI Act et ses implications pour chaque entreprise en 2025 fournit un cadre complet pour cette anticipation réglementaire.

Par ailleurs, comme le soulignent les alertes des experts sur les risques de la sécurité IA, la question de la sécurité dépasse la seule conformité réglementaire. Elle engage la responsabilité stratégique de chaque dirigeant dans la définition d’un cadre d’usage responsable.

Il y a quelques années, la sécurité informatique était perçue comme un problème de DSI. Les dirigeants déléguaient, les équipes IT géraient. L’IA générative a changé cette dynamique de fond en comble.

Aujourd’hui, chaque collaborateur est potentiellement un vecteur de fuite de données. Non par malveillance — mais par méconnaissance. Il tape un brief stratégique dans ChatGPT depuis son compte personnel. Il partage un contrat avec Gemini pour en extraire les clauses clés. Il demande à Claude d’analyser un plan de restructuration confidentiel. Ces gestes sont devenus aussi naturels que l’envoi d’un e-mail.

La réponse ne peut pas être l’interdiction. Les entreprises qui tentent de bloquer l’IA perdent simplement en compétitivité au profit de concurrents qui l’utilisent avec plus de discernement. La réponse est la gouvernance : choisir les bons outils, aux bons niveaux d’abonnement, pour les bonnes données — et former les équipes à cette discipline.

Entre ChatGPT, Claude et Gemini, il n’y a pas de choix universellement supérieur. Il y a un choix adapté à votre contexte, à votre secteur, à votre exposition réglementaire. Ce que cet article a tenté de montrer, c’est que ce choix mérite une analyse sérieuse — et non un simple abonnement pris dans l’urgence d’une transformation en cours.

La sécurité IA en entreprise est, finalement, une question de maturité organisationnelle. Les entreprises qui la prennent au sérieux aujourd’hui construisent un avantage concurrentiel durable. Celles qui l’ignorent accumulent un passif de conformité qui finira par se présenter à la facture.

Pour aller plus loin sur la mise en place d’une stratégie IA structurée, l’accompagnement Baair.Solutions propose un diagnostic complet des usages, des outils et de la gouvernance — avec des recommandations concrètes adaptées à la taille et au secteur de votre organisation.

1. ChatGPT utilise-t-il mes données pour entraîner ses modèles ?

ChatGPT utilise les données des utilisateurs gratuits pour entraîner ses modèles par défaut, sauf désactivation manuelle dans les paramètres. Pour les abonnements professionnels — ChatGPT Team, Enterprise et API — les données ne sont pas utilisées pour l’entraînement par défaut. Les entreprises doivent donc s’assurer que leurs collaborateurs utilisent bien les plans professionnels, et non leurs comptes personnels, pour tout usage lié à l’activité.

2. Claude est-il conforme au RGPD pour une utilisation en entreprise ?

Claude for Work et Claude Enterprise offrent des garanties de conformité RGPD solides : non-utilisation des données pour l’entraînement des modèles par défaut, DPA disponible, certifications SOC 2 Type II et ISO 42001. Anthropic publie explicitement sa politique de non-entraînement sur les données professionnelles. Ces garanties s’appliquent aux plans Team et Enterprise — pas aux comptes grand public, soumis à des règles différentes depuis la mise à jour de 2025.

3. Gemini est-il sécurisé pour partager des données confidentielles ?

Gemini grand public enregistre les interactions et peut les utiliser pour améliorer les services Google, avec une possible relecture humaine. Gemini Business et Enterprise offrent des garanties contractuelles via les DPA Google Workspace, avec les certifications SOC 2 et ISO 27001. La principale vigilance concerne l’intégration avec les autres services Google, qui crée des possibilités de croisement de données à surveiller dans le cadre RGPD.

4. Quelle IA est la plus sécurisée pour une PME française ?

Pour une PME française soumise au RGPD, le choix le plus sécurisé dépend du contexte. Claude Enterprise se distingue par sa politique de non-entraînement par défaut et ses certifications spécifiques à l’IA. Gemini Business reste le plus économique pour les entreprises déjà sur Google Workspace. ChatGPT Team offre un bon compromis. Dans tous les cas, les plans professionnels — jamais les versions gratuites — sont indispensables pour tout usage impliquant des données sensibles.

5. Qu’est-ce que le Cloud Act et pourquoi est-ce important pour les entreprises européennes ?

Le Cloud Act américain de 2018 autorise les autorités des États-Unis à accéder aux données détenues par des entreprises américaines, y compris sur des serveurs situés hors des États-Unis. Pour les entreprises européennes utilisant ChatGPT, Claude ou Gemini — tous basés aux USA — cela signifie que leurs données pourraient théoriquement être requises par des autorités américaines, indépendamment du RGPD. Ce risque est réel mais gérable via des DPA appropriés et le choix de plans Enterprise avec garanties de localisation.

6. Faut-il une charte IA pour utiliser ces outils en entreprise ?

Oui, une charte d’usage IA est indispensable dès que plusieurs collaborateurs utilisent des outils IA pour des tâches professionnelles. Elle doit définir les outils autorisés par profil, les catégories de données à ne jamais partager avec une IA externe, et le processus de validation des contenus générés. Sans ce cadre, même l’outil le plus sécurisé peut devenir un vecteur de fuite de données involontaire. L’EU AI Act renforce progressivement cette obligation pour les usages à risque.

95 % des entreprises ne tirent aucun ROI de l’IA. Sans gouvernance IA entreprise, c’est l’incompétence qui s’industrialise. Décryptage et solutions.

Le mémo interne de Dario Amodei révèle comment gouvernance IA militaire et politique se sont percutées. Ce que tout dirigeant doit comprendre.

L’IA France pivot économique impose un choix radical. De l’AGI à l’énergie, analyse des leviers pour éviter le déclassement technologique définitif.

Économie de services à 80%, coût du travail élevé : pourquoi l’IA et l’emploi en France forment un cas d’usage particulièrement risqué.