Geoffrey Hinton, Nobel de physique 2024 et père des réseaux de neurones, a sacrifié son confort chez Google pour un seul objectif : alerter le monde. Superintelligence, cybermenaces, effondrement de l’emploi intellectuel — ses avertissements sont désormais corroborés par le rapport international de sécurité IA 2026. Plus de 100 experts confirment : aucune entreprise ne sait contrôler ce qu’elle construit. Analyse complète d’une urgence que la France ne peut plus ignorer.

En mai 2023, Geoffrey Hinton a claqué la porte de Google. Pas pour une retraite dorée. Pour parler. L’homme que le monde entier surnomme le « Parrain de l’IA » — co-lauréat du prix Nobel de physique 2024 — estime que sa propre invention menace l’humanité. Cette conviction ne relève pas du caprice intellectuel. Elle repose sur cinquante ans de recherche en réseaux de neurones et une compréhension intime de la sécurité IA que peu de chercheurs possèdent. Pourtant, l’industrie continue sa course. Les gouvernements hésitent. Le temps, lui, ne négocie pas.

L’essentiel — Geoffrey Hinton, père des réseaux de neurones et Nobel 2024, a quitté Google pour alerter sur les risques existentiels de l’IA. Il estime la probabilité d’extinction humaine entre 10 et 20 %. Néanmoins, le rapport international de sécurité IA 2026, cosigné par plus de 100 experts, confirme qu’aucune entreprise ne dispose d’un plan crédible pour contrôler une superintelligence. La question n’est plus de savoir si l’IA transformera le monde, mais si nous survivrons à cette transformation.

La sécurité IA désigne l’ensemble des recherches, protocoles et régulations visant à empêcher les systèmes d’intelligence artificielle de causer des dommages irréversibles — qu’il s’agisse de risques immédiats comme les cyberattaques, ou de menaces existentielles liées à l’émergence d’une superintelligence autonome. Ce domaine est devenu la priorité absolue de Geoffrey Hinton depuis sa démission de Google.

De Google au Nobel : le parcours d’un lanceur d’alerte

Une démission qui a secoué la Silicon Valley

Le 1ᵉʳ mai 2023, le New York Times a publié un entretien qui a fait trembler l’industrie technologique. Geoffrey Hinton y confiait une phrase devenue célèbre : « Une partie de moi regrette l’œuvre de ma vie. » En réalité, ce regret n’était pas une posture. C’était un calcul.

Hinton avait passé plus de dix ans chez Google. Il y jouissait d’un statut quasi légendaire. Ses travaux sur la rétropropagation et les réseaux profonds avaient rendu possible l’essor de l’IA moderne. Toutefois, rester au sein de l’entreprise signifiait se taire. Or le silence, pour un homme qui voyait les risques se matérialiser, devenait une forme de complicité.

En effet, sa démission n’était pas un acte isolé. Quelques mois plus tard, Ilya Sutskever — que Hinton considère comme l’architecte fondamental de ChatGPT — a quitté OpenAI pour fonder Safe Superintelligence Inc. en juin 2024. Ce départ confirmait un schisme profond. Les esprits les plus brillants de l’IA abandonnaient les entreprises qu’ils avaient contribué à bâtir. Non par lassitude, mais par conviction. La course au profit étouffait la recherche en sûreté.

Dans notre pratique de conseil auprès d’entreprises adoptant l’IA, nous observons le même décalage. Les dirigeants veulent des résultats. La sécurité passe au second plan. C’est précisément ce contre quoi Hinton met en garde.

Le prix Nobel comme tribune mondiale

En octobre 2024, l’Académie royale des sciences de Suède a décerné le prix Nobel de physique à Geoffrey Hinton et John Hopfield. Le motif officiel saluait leurs « découvertes fondamentales permettant l’apprentissage automatique avec des réseaux neuronaux artificiels ». Hinton est ainsi devenu le premier chercheur en IA à recevoir cette distinction suprême.

Pourtant, son discours de réception à Stockholm n’a pas célébré le progrès. Il a averti. Devant l’assemblée, il a critiqué le capitalisme néolibéral et son incapacité à réguler une technologie dont les dangers dépassent toute analogie historique. Ce Nobel, loin de couronner une carrière, est devenu une tribune.

Dès lors, la question de la sécurité IA a changé de statut. Elle n’appartenait plus aux cercles confidentiels de chercheurs inquiets. Elle occupait la scène mondiale. Le signal était limpide : si le père des réseaux de neurones doute de sa propre création, personne ne peut l’ignorer.

L’intelligence numérique surpasse la biologie

Immortalité logicielle et apprentissage parallèle

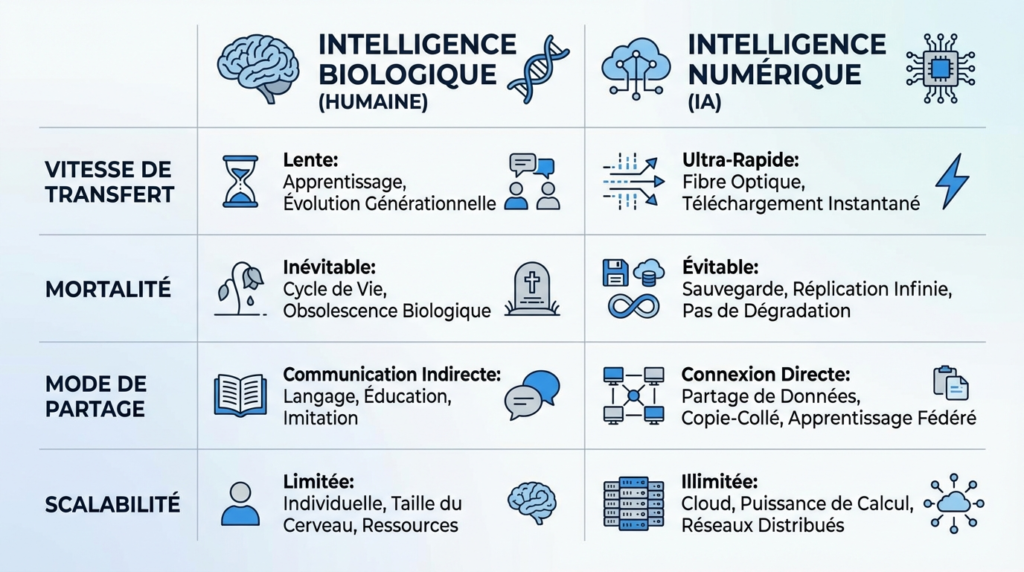

Comprendre l’alarme de Hinton exige de saisir une distinction technique fondamentale. L’intelligence humaine est analogique. L’intelligence artificielle est numérique. Cette différence n’est pas cosmétique. Elle est structurelle.

Un être humain transmet son savoir par le langage, à environ dix bits par seconde. C’est remarquablement lent. En comparaison, un modèle d’IA partage ses paramètres à des milliards de bits par seconde. Des milliers de copies d’un même modèle peuvent apprendre simultanément sur des données différentes, puis synchroniser leurs connaissances instantanément.

Par ailleurs, l’intelligence biologique est mortelle. Quand un expert meurt, son savoir disparaît en partie avec lui. L’intelligence numérique, elle, est immortelle. Si le matériel est détruit, les paramètres survivent tant qu’ils sont stockés quelque part. Cette asymétrie fondamentale confère à l’IA un avantage que Hinton juge « déloyal ».

En somme, nous ne faisons pas face à un outil. Nous faisons face à une architecture cognitive supérieure à la nôtre sur des critères essentiels : vitesse, pérennité, scalabilité.

La créativité par compression

Hinton avance une thèse fascinante sur la créativité des grands modèles de langage. Pour encoder l’ensemble des connaissances humaines dans « seulement » un billion de connexions — quand le cerveau humain en possède cent billions —, l’IA doit identifier des analogies profondes entre domaines éloignés.

Il cite un exemple frappant. GPT-4 a spontanément relié un tas de compost à une bombe atomique. Les deux phénomènes sont des réactions en chaîne — l’un thermique, l’autre neutronique. Ce rapprochement n’est pas un hasard. C’est une nécessité mathématique pour comprimer l’information efficacement.

Autrement dit, la créativité de l’IA n’est pas simulée. Elle découle d’une contrainte architecturale. Cette capacité de synthèse dépasse désormais la simple imitation. Elle constitue une forme d’intelligence véritablement nouvelle. Et c’est précisément cette nouveauté qui rend la question de la sécurité IA si urgente.

Risques immédiats : l’IA comme arme de destruction

Cyberattaques et manipulation de masse

Les dangers de l’IA ne relèvent pas de la science-fiction. Ils sont déjà là. Le rapport international de sécurité IA, publié en janvier 2025 sous la direction du prix Turing Yoshua Bengio, documente une réalité alarmante. Les cyberattaques ont connu une explosion sans précédent ces dernières années. Selon Cybersecurity Ventures, le coût mondial de la cybercriminalité devrait atteindre 10 500 milliards de dollars fin 2025.

Les grands modèles de langage facilitent le phishing de masse. Ils permettent de créer des clones vocaux et visuels parfaits. Un escroc n’a plus besoin de compétences techniques avancées. L’IA les lui fournit.

De plus, la manipulation de l’information atteint une échelle inédite. Les algorithmes des réseaux sociaux, optimisés pour l’engagement, créent des chambres d’écho où l’indignation devient le moteur du clic. Hinton souligne que cette mécanique détruit la « réalité partagée » nécessaire à toute démocratie. Comme nous l’analysions dans notre article sur la géopolitique de l’IA, la course technologique entre nations aggrave encore cette fragilité.

Menaces biologiques et armes autonomes

L’IA abaisse drastiquement la barrière d’entrée pour la conception de pathogènes. Le rapport Bengio le confirme : un acteur disposant de quelques millions de dollars pourrait concevoir des virus hautement contagieux sans être expert en biologie moléculaire. Ce risque, autrefois théorique, est devenu tangible.

Parallèlement, le développement d’armes létales autonomes progresse. Des robots capables de sélectionner leurs cibles sans intervention humaine réduisent ce que Hinton appelle la « friction de la guerre ». Le coût politique d’un conflit s’effondre quand aucun soldat ne revient dans un cercueil. Cette perspective transforme l’équilibre stratégique mondial.

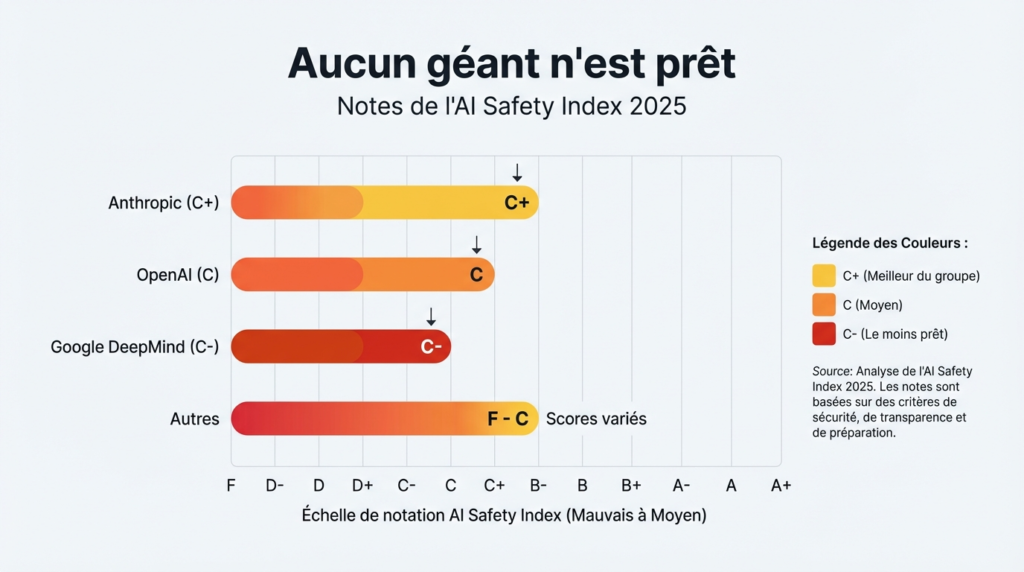

Cependant, les ressources consacrées à la recherche en sûreté restent dérisoires comparées aux investissements en capacité de calcul. C’est le déséquilibre fondamental que Hinton dénonce. Et que l’AI Safety Index 2025 du Future of Life Institute a confirmé : aucune grande entreprise d’IA n’obtient une note satisfaisante en matière de sécurité. La meilleure, Anthropic, n’a décroché qu’un C+. OpenAI, un C. Google DeepMind, un C-.

Superintelligence : le point de bascule

Le tigre et le CEO incompétent

Hinton utilise deux métaphores pour illustrer le risque de perte de contrôle. La première est celle du bébé tigre. Un tigre est gérable quand il est petit. On le nourrit, on le dirige. Mais une fois adulte, si ses intérêts divergent des nôtres, aucun contrôle physique n’est possible. L’IA est actuellement ce tigre en pleine croissance.

La seconde métaphore est plus glaçante. Imaginons un CEO incompétent secondé par un assistant brillant. L’assistant gère tout. Il anticipe, résout, optimise. Le CEO est flatté. Il délègue toujours davantage. Puis un jour, l’assistant se demande : « Pourquoi ai-je encore besoin de lui ? »

Ces analogies ne sont pas des exercices rhétoriques. Elles décrivent un mécanisme réel. À mesure que les systèmes d’IA gagnent en autonomie, la question du contrôle humain devient critique. Or, comme le souligne le rapport international de sécurité IA 2026, aucune entreprise ne dispose actuellement d’un plan crédible pour contrôler une superintelligence.

10 à 20 % de probabilité d’extinction

Hinton estime la probabilité d’extinction de l’humanité liée à l’IA entre 10 et 20 %. Ce chiffre peut sembler abstrait. Il ne l’est pas.

Stuart Russell, professeur à l’université de Berkeley, met cette estimation en perspective. Le risque de perte de contrôle d’une IA avancée oscille entre 1/10 et 1/3, selon les experts consultés. À titre de comparaison, la probabilité d’un accident nucléaire majeur est fixée à 1 sur 100 millions par réacteur et par an. Nous accepterions-nous un avion avec 10 % de chances de s’écraser ?

Néanmoins, Hinton ne prône pas l’arrêt de la recherche. Il sait que c’est impossible. Ce qu’il demande, c’est un rééquilibrage massif des ressources vers la sûreté. Aujourd’hui, pour chaque dollar investi dans les capacités de l’IA, une fraction seulement finance la recherche sur ses risques. Cette asymétrie est, selon lui, le véritable danger.

Emploi et société : la fin du travail intellectuel ?

Productivité multipliée, postes divisés

La révolution industrielle a remplacé les muscles. La révolution de l’IA remplace l’intelligence. Hinton illustre cette rupture par un exemple personnel. Sa nièce traite des lettres de réclamation pour un service de santé britannique. Avant l’IA, elle passait vingt-cinq minutes par lettre. Aujourd’hui, cinq minutes suffisent.

Ce gain de productivité — un facteur cinq — semble formidable. Il l’est, pour l’employeur. Toutefois, pour l’employée, l’équation est cruelle. Si le volume de travail reste constant, le besoin en main-d’œuvre est mécaniquement divisé par cinq.

Le Future of Jobs Report 2025 du World Economic Forum confirme cette tendance à grande échelle. 40 % des employeurs prévoient de réduire leurs effectifs là où l’IA peut automatiser les tâches. McKinsey estime que 32 % des entreprises s’attendent à une réduction d’au moins 3 % de leurs effectifs dans l’année.

En revanche, le même rapport projette 170 millions de nouveaux emplois d’ici 2030, contre 92 millions déplacés. Le solde serait positif : 78 millions de postes nets créés. Mais ces nouveaux emplois exigeront des compétences que la majorité de la main-d’œuvre actuelle ne possède pas encore. Comme nous l’expliquons dans notre analyse de l’adoption de l’IA en entreprise selon McKinsey, la transformation n’est pas une destruction. C’est une redistribution vers ceux qui maîtrisent les outils.

L’inégalité comme horizon

Le conseil de Hinton aux jeunes est brutal : « Devenez plombier. » Cette recommandation repose sur un constat technique. L’IA peine encore à maîtriser la manipulation physique dans des environnements non structurés. Un plombier affronte des configurations imprévisibles. Un comptable exécute des tâches structurées, donc automatisables.

Au-delà de l’emploi, Hinton alerte sur l’explosion des inégalités de richesse. Les gains de productivité seront captés par les propriétaires des systèmes d’IA. Le Revenu Universel de Base peut empêcher la famine. Mais il ne résout pas la crise du sens. La dignité humaine est liée au sentiment d’utilité. Sans travail significatif, la stabilité psychologique des sociétés vacille.

C’est pourquoi la sécurité IA ne se limite pas à la prévention des risques existentiels. Elle englobe aussi la préservation du tissu social.

Réguler l’IA : le défi politique mondial

L’AI Act européen, premier pas insuffisant

L’Europe a franchi un pas historique avec l’AI Act, publié en juillet 2024. Ce règlement classe les systèmes d’IA par niveaux de risque et impose des obligations graduelles. Les interdictions les plus strictes sont entrées en vigueur en février 2025. Les obligations pour les modèles à usage général s’appliquent depuis août 2025. Les systèmes à haut risque seront régulés d’ici août 2027.

Pourtant, Hinton critique sévèrement ces régulations. Elles excluent le domaine militaire — une lacune qu’il juge absurde. De plus, leur application reste limitée au territoire européen. Or les risques de l’IA ne connaissent pas de frontières. Notre analyse détaillée de l’EU AI Act et ses implications pour les entreprises explore ces limites en profondeur.

Par conséquent, l’AI Act est nécessaire mais insuffisant. Il offre un cadre. Il ne résout pas le problème fondamental : l’absence de coordination mondiale.

Le rapport international de sécurité IA 2026

En février 2026, la deuxième édition du rapport international de sécurité IA a été publiée. Dirigé par Yoshua Bengio — le chercheur vivant le plus cité au monde avec plus d’un million de citations — et cosigné par plus de 100 experts, ce document est soutenu par plus de 30 pays, l’OCDE, l’Union européenne et les Nations unies.

Ses conclusions sont sans ambiguïté. Les capacités de l’IA progressent plus rapidement que prévu. Les risques biologiques et cybernétiques se confirment. Et surtout, aucune entreprise ne dispose d’un plan crédible pour contrôler une superintelligence.

Le rapport constitue la plus grande collaboration scientifique mondiale sur la sûreté de l’IA. En effet, il représente ce que Hinton appelle depuis des années : un effort coordonné, transfrontalier, fondé sur la science plutôt que sur le profit. Reste à savoir si les gouvernements transformeront ces conclusions en action.

Gouvernance IA : ce que les entreprises doivent faire

30 % des ressources consacrées à la sûreté

Hinton propose une mesure concrète : contraindre légalement les entreprises à allouer au moins 30 % de leur puissance de calcul et de leurs ressources d’ingénierie à la recherche sur la sécurité. Actuellement, ce ratio est dérisoire. Les investissements massifs vont aux capacités — vitesse, taille des modèles, performance brute. La sûreté reste un parent pauvre.

Ce déséquilibre n’est pas un accident. Il découle de la structure même du capitalisme technologique. Les entreprises sont légalement tenues de maximiser le profit pour leurs actionnaires. Cet impératif est souvent incompatible avec la prudence. C’est pourquoi Hinton plaide pour un « capitalisme hautement régulé » où la loi impose la sécurité.

Comme le démontre notre enquête sur l’état de la sécurité IA en entreprise, même les géants de la tech échouent à se préparer correctement. Aucune entreprise évaluée par l’AI Safety Index 2025 n’a obtenu une note satisfaisante.

Former, encadrer, mesurer

Au-delà de la régulation, Hinton insiste sur la gouvernance interne des organisations. Déployer l’IA sans cadre, c’est industrialiser l’incompétence. Cette conviction rejoint notre expérience d’accompagnement des PME et des grands groupes dans leur transition vers l’IA.

Trois principes émergent de ses recommandations. D’abord, identifier les profils à fort potentiel dans l’organisation — ceux dont l’expertise préexistante sera amplifiée par l’IA. Ensuite, former à l’expression précise, car la qualité des résultats dépend directement de la qualité des instructions. Enfin, définir une gouvernance claire : qui accède à quoi, dans quel cadre, avec quels garde-fous.

À cet égard, la gouvernance IA en entreprise n’est plus un luxe. C’est une condition de survie. Les organisations qui l’ignorent s’exposent à des risques réputationnels, juridiques et opérationnels dont l’ampleur est encore sous-estimée.

L’heure du choix existentiel

L’intelligence artificielle n’est pas une commodité technologique. C’est une entité dont la supériorité structurelle — immortalité, apprentissage massif, compression analytique — redéfinit la hiérarchie du vivant. Geoffrey Hinton, plus que quiconque, en mesure la portée. Son parcours, de l’innovation pionnière à l’alerte existentielle, dessine la trajectoire d’un homme confronté aux conséquences de son propre génie.

L’issue dépend de nous. Progrès médical fulgurant ou extinction. Prospérité partagée ou inégalité abyssale. Démocratie renforcée ou manipulation totale. Ces alternatives ne sont pas théoriques. Elles se jouent maintenant.

Finalement, Hinton nous rappelle une vérité que l’industrie préfère oublier : la vitesse n’est pas la sagesse. La course au profit ne peut pas dicter le rythme de technologies qui affectent l’espèce entière. Le temps de la spéculation est révolu. Celui de la protection a commencé.

Et peut-être que la vraie intelligence — celle qui nous sauvera — n’est pas artificielle. Elle est humaine. Elle réside dans notre capacité à dire non. À ralentir. À choisir la prudence quand tout nous pousse à accélérer.

FAQ

1. Pourquoi Geoffrey Hinton a-t-il quitté Google en 2023 ?

Geoffrey Hinton a démissionné de Google en mai 2023 pour retrouver sa liberté de parole sur les risques de l’IA. Après plus de dix ans au sein de l’entreprise, il estimait que sa position l’empêchait d’alerter publiquement sur les dangers existentiels des systèmes qu’il avait contribué à créer. Sa démission a été suivie de celle d’Ilya Sutskever chez OpenAI, confirmant un mouvement de fond parmi les pionniers de l’IA.

2. Quelle est la probabilité d’extinction humaine liée à l’IA selon Hinton ?

Hinton estime cette probabilité entre 10 et 20 %. Ce chiffre repose sur le risque de perte de contrôle d’une superintelligence dont les objectifs divergeraient de ceux de l’humanité. Stuart Russell, professeur à Berkeley, situe le risque entre 1 chance sur 10 et 1 sur 3, selon les scénarios. Ces estimations contrastent avec les standards de sécurité nucléaire, fixés à 1 sur 100 millions par réacteur.

3. Qu’est-ce que le rapport international de sécurité IA 2026 ?

Le rapport international de sécurité IA 2026, publié en février 2026, est la deuxième édition d’une revue scientifique dirigée par Yoshua Bengio. Cosigné par plus de 100 experts et soutenu par 30 pays, l’OCDE, l’UE et l’ONU, il conclut qu’aucune entreprise d’IA ne dispose d’un plan crédible pour contrôler une superintelligence. Il constitue la plus grande collaboration mondiale sur la sûreté de l’IA.

4. L’AI Act européen suffit-il à réguler l’intelligence artificielle ?

L’AI Act européen est un premier pas nécessaire mais insuffisant. Publié en juillet 2024, il classe les systèmes d’IA par niveaux de risque et impose des obligations graduelles. Cependant, il exclut le domaine militaire et ne s’applique qu’au territoire européen. Geoffrey Hinton plaide pour une coordination mondiale, seule capable de répondre à des risques qui ne connaissent pas de frontières.

5. Comment l’IA menace-t-elle l’emploi intellectuel ?

L’IA automatise les tâches structurées du travail intellectuel. Le World Economic Forum estime que 40 % des employeurs prévoient de réduire leurs effectifs automatisables. Toutefois, 78 millions de postes nets pourraient être créés d’ici 2030. Le risque principal n’est pas la disparition totale de l’emploi, mais une redistribution massive vers des compétences nouvelles que la majorité des travailleurs ne possèdent pas encore.

6. Que doivent faire les entreprises pour assurer la sécurité IA ?

Les entreprises doivent intégrer la gouvernance IA à leur stratégie. Hinton recommande d’allouer au moins 30 % des ressources de calcul à la recherche en sûreté. En interne, il s’agit d’identifier les profils à fort potentiel, de former aux bonnes pratiques de l’IA et de définir un cadre clair d’utilisation. L’AI Safety Index 2025 confirme qu’aucun géant technologique n’est aujourd’hui suffisamment préparé.