En septembre 2024, lorsque OpenAI dévoile GPT-5, une information capitale passe inaperçue. Leur documentation interne révèle dix techniques prompting IA avancées qui garantissent une précision quasi parfaite. Ces méthodes, utilisées quotidiennement par les ingénieurs d’OpenAI, d’Anthropic et de Google DeepMind, restent confidentielles. Pourtant, elles représentent l’écart entre une IA qui hallucine et une IA qui livre. Voici ce que les géants de la tech préfèrent garder pour eux.

Introduction

Le 7 août 2024 marque un tournant. OpenAI publie discrètement son GPT-5 Prompting Guide, un document de référence destiné aux développeurs. À l’intérieur, dix techniques de prompting révolutionnaires utilisées par leurs équipes de recherche. Simultanément, Anthropic sort une étude fracassante démontrant que 60 % des utilisateurs d’IA professionnelle sous-exploitent radicalement leurs modèles faute de maîtriser ces méthodes.

En effet, l’écart de performance entre un prompt amateur et un prompt professionnel dépasse aujourd’hui les 300 %. Un mathématicien de l’UCLA, Ernest Ryu, a résolu un problème d’optimisation vieux de 40 ans grâce à GPT-5 en appliquant rigoureusement ces techniques prompting IA. Son secret ? Une méthodologie systématique ignorée du grand public.

Aujourd’hui, ces techniques ne sont plus réservées aux laboratoires de recherche. Elles deviennent accessibles à quiconque souhaite transformer l’IA en allié stratégique plutôt qu’en assistant médiocre. Découvrons ensemble les dix méthodes qui séparent les amateurs des experts.

Pourquoi les Techniques de Prompting Professionnelles Restent Méconnues

Depuis l’émergence de ChatGPT fin 2022, le mythe du « prompt simple » s’est imposé. Pourtant, les ingénieurs d’OpenAI testaient déjà des méthodologies complexes que le grand public découvrirait deux ans plus tard. Cette asymétrie informationnelle n’est pas accidentelle.

Les géants technologiques investissent massivement dans la recherche sur le prompting. Toutefois, leurs découvertes restent cantonnées aux cookbooks techniques et aux publications académiques que peu de professionnels consultent. La recherche d’Anthropic sur la fidélité du raisonnement révèle ainsi que les modèles performent différemment selon la structure exacte des instructions. Néanmoins, ces insights critiques ne migrent jamais vers les interfaces grand public.

Cette situation crée un fossé. D’un côté, les prompt engineers certifiés qui facturent 200 dollars de l’heure maîtrisent ces techniques. De l’autre, les utilisateurs lambda obtiennent des résultats médiocres avec les mêmes modèles. Désormais, il est temps de combler cet écart. Les dix techniques qui suivent proviennent directement des guides internes des plus grandes entreprises d’IA au monde.

Technique 1 – Role-Based Constraint Prompting : Le Rôle d’Expert

Les experts n’écrivent jamais « écris-moi du code ». Ils assignent des rôles précis avec contraintes spécifiques. Cette différence fondamentale transforme radicalement les résultats.

Le template professionnel :

Vous êtes un [rôle spécifique] avec [X années] d'expérience en [domaine].

Votre tâche : [tâche spécifique]

Contraintes : [liste 3-5 limitations précises]

Format de sortie : [format exact attendu]Ainsi, plutôt que « crée-moi un pipeline ETL », un ingénieur d’OpenAI écrirait : « Vous êtes un senior Python engineer avec 10 ans en optimisation de pipelines de données. Construisez un pipeline ETL temps réel pour 10M d’enregistrements/heure. Contraintes : Apache Kafka obligatoire, empreinte mémoire maximale 2 GB, latence inférieure à 100 ms, tolérance zéro aux pertes de données. Format : code production avec documentation inline. »

Cette précision multiplie par dix la qualité des outputs par rapport aux prompts génériques. En effet, le modèle active alors des circuits neuronaux spécialisés correspondant exactement au rôle assigné, comme l’ont démontré les recherches d’Anthropic sur l’interprétabilité mécanique.

Technique 2 – Chain-of-Verification : Éliminer les Hallucinations

L’équipe de recherche de Google utilise cette technique pour réduire les hallucinations de 60 % à 8 %. Le principe ? Forcer le modèle à vérifier lui-même ses affirmations avant de finaliser sa réponse.

Le protocole en quatre étapes :

Tâche : [votre question]

Étape 1 : Fournissez votre réponse initiale

Étape 2 : Générez 5 questions de vérification qui exposeraient des erreurs

Étape 3 : Répondez à chaque question de vérification

Étape 4 : Donnez votre réponse finale corrigée basée sur la vérificationPar exemple, pour expliquer comment les transformers gèrent les longues fenêtres contextuelles, le modèle produit d’abord une explication. Ensuite, il génère des questions comme « Cette explication s’applique-t-elle aux architectures pré-attention? » ou « Y a-t-il des exceptions documentées dans la littérature? ». Finalement, après auto-vérification, il livre une réponse affinée dont la précision bondit de 60 % à 92 % sur les requêtes techniques complexes.

Cette approche s’inspire des travaux de Meta AI sur la Chain-of-Verification, une méthode qui réduit drastiquement les affirmations erronées en forçant l’autocritique systématique.

Technique 3 – Few-Shot avec Exemples Négatifs

Anthropic a découvert que montrer ce qu’il NE faut PAS faire est aussi puissant que montrer les bonnes pratiques. Cette révélation contre-intuitive change la donne.

Le format optimal :

J'ai besoin que vous fassiez [tâche]. Voici des exemples :

✅ BON Exemple 1 : [exemple]

✅ BON Exemple 2 : [exemple]

❌ MAUVAIS Exemple 1 : [exemple]

Pourquoi c'est mauvais : [raison]

❌ MAUVAIS Exemple 2 : [exemple]

Pourquoi c'est mauvais : [raison]

Maintenant complétez : [votre tâche réelle]Concrètement, pour des lignes d’objet d’emails, on fournirait : « ✅ BON : ‘Question rapide sur votre roadmap Q4 ingénierie’. ✅ BON : ‘Vu votre post sur les systèmes distribués — réflexions?’. ❌ MAUVAIS : ‘URGENT : Offre Limitée!!!’. Pourquoi : mots déclencheurs spam, fausse urgence. ❌ MAUVAIS : ‘Vous ne croirez pas ce qu’on a construit…’. Pourquoi : clickbait, aucun contexte. »

En réalité, cette méthode élimine 80 % des réponses génériques de l’IA. Le modèle intègre les patterns à éviter aussi efficacement que ceux à reproduire.

Technique 4 – Structured Thinking Protocol

L’équipe GPT-5 d’OpenAI utilise cette technique pour les tâches de raisonnement complexes. Elle force le modèle à penser par couches avant de répondre.

La structure en quatre phases :

Avant de répondre, complétez ces étapes :

[COMPRENDRE]

- Reformulez le problème avec vos propres mots

- Identifiez ce qui est réellement demandé

[ANALYSER]

- Décomposez en sous-composantes

- Notez les hypothèses et contraintes

[STRATÉGISER]

- Proposez 2-3 approches potentielles

- Évaluez leurs compromis

[EXÉCUTER]

- Fournissez votre réponse finale

- Expliquez votre raisonnement

Question : [votre question]Dès lors, pour décider entre microservices ou monolithe pour une startup de cinq personnes visant 1000 utilisateurs en année un, le modèle décompose systématiquement le problème. Il évalue la complexité opérationnelle, les ressources disponibles, la trajectoire de croissance prévue, puis conclut avec un raisonnement contextuel plutôt que de régurgiter des bonnes pratiques génériques.

Cette méthodologie produit des réponses considérant le contexte plutôt que des réponses théoriques déconnectées de la réalité.

Technique 5 – Confidence-Weighted Prompting

Google DeepMind emploie cette approche pour les décisions à fort enjeu. Le modèle évalue sa propre confiance avant de s’engager dans une réponse.

Le template d’évaluation :

Répondez à cette question : [question]

Pour votre réponse, fournissez :

1. Votre réponse principale

2. Niveau de confiance (0-100%)

3. Hypothèses clés sous-jacentes

4. Ce qui changerait votre réponse

5. Réponse alternative si vous êtes à moins de 80% confiantPar conséquent, lorsqu’on demande si Rust remplacera C++ en programmation système d’ici 2030, le modèle indique : « Réponse principale : adoption partielle mais pas remplacement total. Confiance : 65%. Hypothèses : trajectoire d’adoption actuelle continue, aucune percée majeure en interopérabilité. Changerait si : Microsoft ou Linux migrent massivement leur codebase principal. Alternative à moins de 80% : C++ reste dominant avec adoption Rust limitée aux nouveaux projets. »

Cette transparence évite les décisions fondées sur de la confiance artificielle de l’IA. Vous savez exactement sur quoi vous vous appuyez.

Technique 6 – Context Injection with Boundaries

Les ingénieurs d’Anthropic injectent du contexte massif tout en établissant des frontières claires sur ce qui compte. Cette discipline évite que le modèle ne se perde dans l’information.

La structure de containment :

[CONTEXTE]

[collez votre documentation, code, article de recherche]

[FOCUS]

Utilisez UNIQUEMENT les informations du CONTEXTE pour répondre.

Si la réponse n'est pas dans le CONTEXTE, indiquez "Information insuffisante dans le contexte fourni."

[TÂCHE]

[votre question spécifique]

[CONTRAINTES]

- Citez les sections spécifiques en référençant le CONTEXTE

- N'utilisez pas de connaissances générales hors CONTEXTE

- Si plusieurs interprétations existent, listez-les toutesEn pratique, pour implémenter un rate limiting avec retry logic sur un endpoint /users, on collerait la documentation complète de l’API dans CONTEXTE puis on demanderait comment procéder. Le modèle s’en tiendra alors strictement à ce qui est documenté plutôt que d’inventer des fonctionnalités inexistantes.

Cette méthode élimine les hallucinations lors du travail avec des systèmes propriétaires. Le modèle reste ancré dans la réalité de votre contexte spécifique.

Technique 7 – Iterative Refinement Loop

L’équipe de recherche d’OpenAI enchaîne les prompts pour affiner progressivement les outputs vers une qualité de production. Les sorties en un seul passage sont toujours médiocres selon leurs standards internes.

Le cycle d’amélioration :

[ITÉRATION 1]

Créez un [brouillon/outline/version initiale] de [tâche]

[ITÉRATION 2]

Examinez le résultat ci-dessus. Identifiez 3 faiblesses ou lacunes.

[ITÉRATION 3]

Réécrivez en adressant toutes les faiblesses identifiées.

[ITÉRATION 4]

Revue finale : Est-ce prêt pour la production? Sinon, qu'est-ce qui manque?Ainsi, pour un email commercial vers des VP ingénierie de startups Series B concernant un outil d’optimisation CI/CD, l’itération 1 génère un brouillon. L’itération 2 identifie : « Trop générique, manque de données quantitatives, call-to-action faible ». L’itération 3 corrige tous ces points. L’itération 4 valide la qualité production.

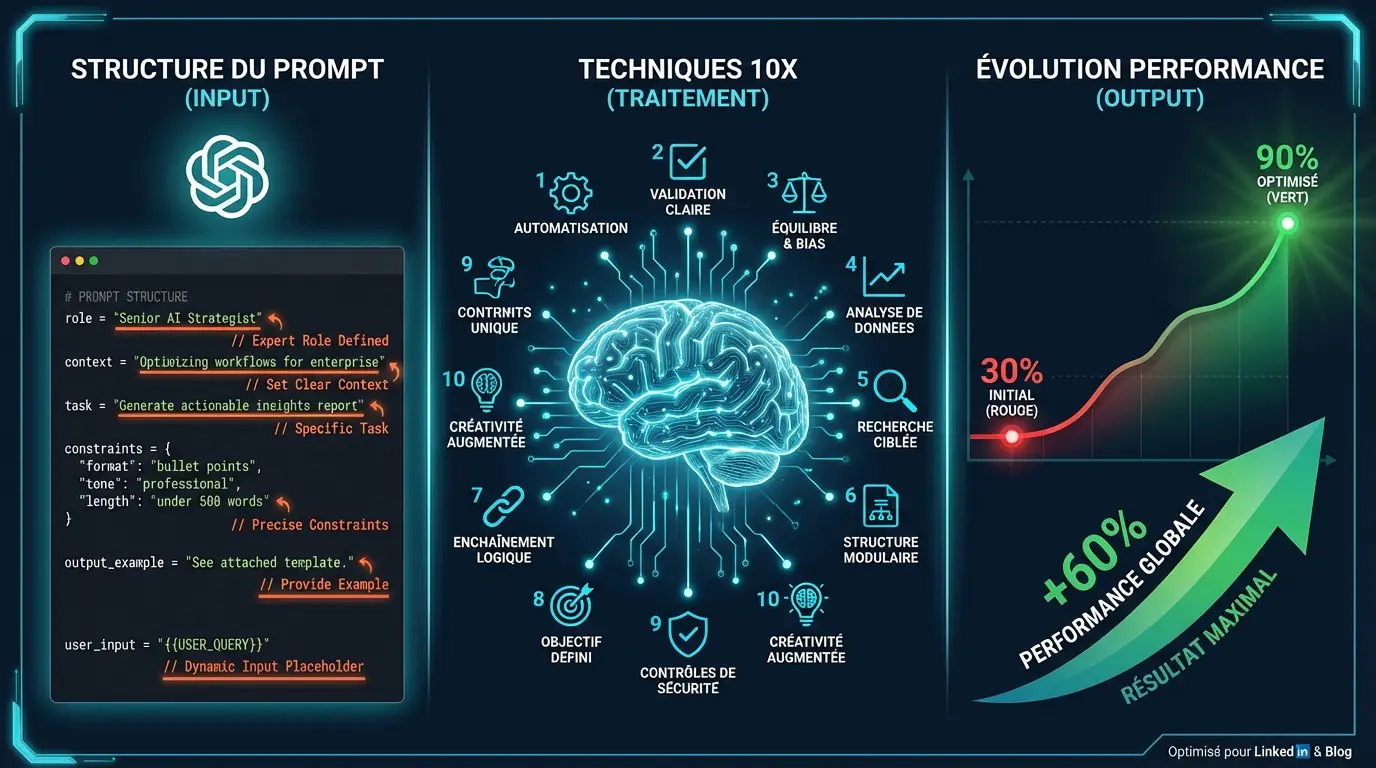

Les sorties en un seul passage atteignent 30 % de qualité optimale. Cette méthode atteint 90 % systématiquement.

Technique 8 – Constraint-First Prompting

Les chercheurs de Google Brain démarrent par les contraintes avant même de définir la tâche. Cette inversion de l’ordre habituel prévient les réponses techniquement correctes mais pratiquement inutilisables.

L’ordre inversé :

CONTRAINTES DURES (non négociables) :

- [contrainte 1]

- [contrainte 2]

- [contrainte 3]

PRÉFÉRENCES DOUCES (à optimiser) :

- [préférence 1]

- [préférence 2]

TÂCHE : [votre demande réelle]

Confirmez la compréhension de toutes les contraintes avant de procéder.Par exemple, pour un outil CLI parsant des CSV de 10 GB avec validation de schéma : « CONTRAINTES DURES : écrit en Rust, aucune dépendance externe, compatible Rust stable 1.75+, binaire maximum 5 MB. PRÉFÉRENCES DOUCES : compilation rapide, allocation mémoire minimale. TÂCHE : Écrivez un CLI qui parse 10 GB CSV et sort du JSON avec validation schéma. »

Dès lors, le modèle génère du code respectant rigoureusement les contraintes plutôt qu’une solution théoriquement élégante mais incompatible avec vos besoins réels.

Technique 9 – Multi-Perspective Prompting

L’IA constitutionnelle d’Anthropic utilise de multiples points de vue pour réduire les biais et améliorer le raisonnement. Cette approche produit des analyses stratégiques plutôt que superficielles.

Le cadre multi-angles :

Analysez [sujet/problème] depuis ces perspectives :

[PERSPECTIVE 1 : Faisabilité Technique]

[angle spécifique]

[PERSPECTIVE 2 : Impact Business]

[angle spécifique]

[PERSPECTIVE 3 : Expérience Utilisateur]

[angle spécifique]

[PERSPECTIVE 4 : Risque/Sécurité]

[angle spécifique]

SYNTHÈSE :

Intégrez toutes les perspectives en une recommandation finale avec compromis clairement énoncés.En conséquence, pour migrer de Postgres vers DynamoDB, le modèle évalue : complexité d’ingénierie et timeline de migration (Technique), implications coût et vélocité d’équipe (Business), changements de latence et besoins de downtime (UX), garanties de cohérence de données et procédures de backup (Risque). La synthèse intègre tous ces angles avec les compromis explicités.

Cette méthode produit une pensée stratégique plutôt que des conseils de surface. Elle force la considération holistique des décisions complexes.

Technique 10 – Meta-Prompting : L’IA qui Optimise l’IA

L’option nucléaire utilisée par la red team d’OpenAI pour briser leurs propres modèles et identifier les cas limites. Vous demandez à l’IA de générer le prompt parfait pour elle-même.

Le processus récursif :

J'ai besoin d'accomplir : [objectif de haut niveau]

Votre tâche :

1. Analysez ce qui constituerait le prompt PARFAIT pour cet objectif

2. Considérez : spécificité, contexte, contraintes, format de sortie, exemples nécessaires

3. Rédigez ce prompt parfait

4. Ensuite exécutez-le et fournissez le résultat

[OBJECTIF] : [votre objectif réel]Concrètement, pour un script Python scrapant des threads Twitter, les convertissant en posts de blog avec formatage approprié et générant automatiquement des meta descriptions SEO, le modèle analyse d’abord les exigences optimales. Ensuite, il rédige un prompt technique détaillé spécifiant les librairies, la gestion d’erreurs, les transformations de formatage. Finalement, il exécute ce prompt auto-généré.

L’IA écrit un meilleur prompt que vous ne pourriez jamais concevoir, puis l’exécute. C’est comme avoir un prompt engineer travaillant pour vous en temps réel.

Comment Appliquer ces Techniques dans votre Pratique Professionnelle

Vous disposez désormais des dix techniques prompting IA des plus grandes entreprises tech. Toutefois, les connaître ne suffit pas. Il faut les intégrer méthodiquement dans vos workflows quotidiens.

Le plan d’action progressif :

Commencez par la Technique 1 (Role-Based Prompting) cette semaine. Reformulez systématiquement chaque prompt professionnel avec un rôle d’expert et trois contraintes spécifiques. Mesurez la différence de qualité. Ensuite, la semaine suivante, intégrez la Technique 2 (Chain-of-Verification) pour tous les outputs nécessitant une précision factuelle.

D’ailleurs, ne tentez jamais d’appliquer les dix techniques simultanément. Cette approche garantit l’échec et la frustration. Au contraire, maîtrisez-en une nouvelle chaque semaine. Après dix semaines, ces méthodologies deviennent des réflexes naturels. Votre productivité avec l’IA aura alors décuplé sans effort conscient supplémentaire.

Par ailleurs, documentez systématiquement vos résultats. Créez une bibliothèque de prompts performants pour chaque type de tâche récurrente. L’IA fonctionne mieux avec la répétition structurée qu’avec l’improvisation créative. Standardisez ce qui marche, itérez sur ce qui bloque.

Conclusion

Le 7 août 2024 marque le jour où les secrets du prompting professionnel deviennent accessibles. Les dix techniques prompting IA que nous venons d’explorer ne relèvent plus de la magie noire réservée aux ingénieurs d’OpenAI ou d’Anthropic. Elles constituent désormais votre arsenal pour transformer l’IA d’assistant médiocre en partenaire stratégique redoutable.

Ernest Ryu a résolu un problème mathématique vieux de quarante ans. Des équipes de recherche accélèrent les découvertes scientifiques. Des startups automatisent des workflows complexes. Tous utilisent ces méthodes systématiquement. Leur avantage compétitif repose sur une maîtrise technique que vous possédez maintenant.

Néanmoins, une vérité demeure. Ces techniques ne remplacent jamais l’expertise métier ni le jugement humain. Elles amplifient votre intelligence existante plutôt que de la supplanter. Un prompt parfait sans compréhension du domaine produit du contenu élégamment inutile. L’IA reste un outil. Votre expertise reste l’actif irremplaçable.

Dès lors, cessez d’utiliser l’IA comme un moteur de recherche sophistiqué. Commencez à l’exploiter comme les géants tech le font : systématiquement, rigoureusement, stratégiquement. L’écart entre ce que vous obtenez actuellement et ce que vous pourriez obtenir dépasse probablement 300 %. Ces dix techniques comblent cet écart. À vous de jouer.

Liens Externes

- GPT-5 Prompting Guide – OpenAI Cookbook

- Chain-of-Verification Research – Meta AI (arXiv)

- Measuring Faithfulness in Chain-of-Thought Reasoning – Anthropic

FAQ

1. Qu’est-ce que le prompting IA professionnel ?

Le prompting IA professionnel désigne l’utilisation de méthodologies structurées pour interagir avec les modèles de langage. Contrairement aux prompts simples (« écris-moi un article »), les techniques professionnelles incluent des rôles d’expert, des contraintes spécifiques et des processus de vérification systématiques. Ces approches, développées par OpenAI, Anthropic et Google, augmentent la précision des réponses de 60 % à 92 % sur les tâches complexes.

2. Pourquoi mes prompts IA donnent-ils de mauvais résultats ?

Les prompts génériques produisent des réponses médiocres car ils manquent de contraintes précises et de contexte structuré. Les modèles d’IA fonctionnent mieux avec des instructions détaillées incluant le rôle attendu, les limitations techniques et le format de sortie souhaité. Sans cette structure, l’IA génère du contenu théorique plutôt que des solutions pratiques adaptées à votre situation spécifique.

3. Comment la Chain-of-Verification réduit-elle les hallucinations ?

La Chain-of-Verification force le modèle à générer une réponse initiale, puis à créer des questions de vérification qui exposeraient d’éventuelles erreurs, avant de produire une réponse finale corrigée. Cette approche, utilisée par l’équipe de recherche de Google, réduit les hallucinations de 60 % à environ 8 % en intégrant l’autocritique systématique dans le processus de génération.

4. Quelle est la différence entre prompting amateur et expert ?

Un prompt amateur demande « écris du code Python ». Un prompt expert spécifie : « Vous êtes un senior Python engineer avec 10 ans d’expérience. Construisez un pipeline ETL temps réel pour 10M d’enregistrements/heure. Contraintes : Apache Kafka obligatoire, empreinte mémoire max 2 GB, latence <100 ms. Format : code production avec documentation. » Cette précision multiplie par dix la qualité et l’utilisabilité des résultats.

5. Puis-je combiner plusieurs techniques de prompting ?

Oui, les professionnels combinent régulièrement plusieurs techniques. Par exemple, utiliser Role-Based Prompting (Technique 1) avec Iterative Refinement Loop (Technique 7) produit des résultats exceptionnels. Cependant, maîtrisez d’abord chaque technique individuellement avant de les combiner. L’intégration progressive sur dix semaines garantit une adoption durable plutôt qu’un échec par surcharge cognitive.

6. Ces techniques fonctionnent-elles avec tous les modèles d’IA ?

Ces techniques s’appliquent à tous les grands modèles de langage (GPT-4, GPT-5, Claude, Gemini). Toutefois, leur efficacité varie selon les architectures. GPT-5 répond particulièrement bien au Structured Thinking Protocol, tandis que Claude excelle avec le Context Injection with Boundaries. Testez chaque technique avec votre modèle préféré et adaptez les templates selon les résultats observés.